index.md 258KB

title: Situer le numérique

url: https://situer-le-numerique.netlify.app/

hash_url: 77a2e7a33e

Gauthier Roussilhe

Introduction

Le numérique a souvent été une affirmation, voire une injonction. Pour ses promoteurs, le numérique s’inscrit dans le vecteur du progrès. De fait, son développement a été quasiment non-négociable pour les sociétés modernes de la fin du XXe siècle. Aujourd’hui le numérique devient petit à petit une question. On peut dire schématiquement qu’il aura fallu environ 30 ans depuis le déploiement de l’infrastructure numérique dans la société civile pour qu’un point d’exclamation devienne un point d’interrogation.

Cette question doit maintenant être bien posée. Aujourd’hui, il semble qu’on ne peut plus questionner cette infrastructure sans prendre conscience des changements colossaux, notamment environnementaux, que nous vivons et vivrons. Les activités de certaines sociétés et entreprises humaines ont rapidement dégradé des écosystèmes, et ont transformé des cycles planétaires clés. Les conditions d’existence sur Terre sont amenées à changer durablement et nous ne pouvons pas maintenir des postures héritées de la “modernité” alors même que cette parenthèse se ferme. Ce n’est pas une crise et il n’y aura pas de retour à la “normale”, c’est une évolution des conditions de vie sur Terre. À nous d’adapter nos structures matérielles et conceptuelles afin d’apprendre à vivre avec ces nouvelles conditions. Il est sûrement bon de se rappeler que certains modes de vie hérités de l’abondance énergétique des énergies fossiles, des années 1950 à nos jours, semblent avoir été une exception dans l’histoire des sociétés humaines, et non pas une norme ou le “sens de l’histoire”.

Vivre dans cette nouvelle ère nécessite donc des postures précises pour se questionner et examiner les arbitrages à opérer.

① Premièrement il semble important d’éviter les raisonnements binaires car bien des concepts se sont articulés ainsi : urbain/rural, régression/progrès, gauche/droite, … Les réflexions binaires réduisent les possibilités de résolution d’un problème car chaque élément s’oppose à l’autre et n’admet aucune hybridation. On dit alors que c’est “soit l’un, soit l’autre”, ou “qu’il n’y a pas d’alternative”, même quand d’autres options sont possibles. De même, deux états a priori opposés peuvent vivre simultanément : nous sommes parfois habités par des doutes et des certitudes sur le même sujet. Être certain à propos d’un sujet spécifique n’absout pas des doutes, ils cohabitent. À l’inverse du bipartisme, savoir repérer les continuités et les discontinuités d’une situation est une posture bien plus fertile : il faut alors comprendre et observer les variantes, les autres modèles, les frontières, les dégradés et les épicentres.

② Deuxièmement, imaginer que toute solution ou proposition doive ou puisse être globalisée ou mise à l’échelle relève bien plus de la logique économique moderne que de la logique sociale, géographique, écologique, biologique, etc. Certaines propositions ou solutions peuvent être pertinentes de manière globale mais elles le sont rarement toutes. Nous sommes souvent tentés de globaliser ce que nous avons en tête alors qu’il serait bien mieux, dans un premier temps, d’être pertinent dans un territoire bien décrit. Cela amène à rappeler un point essentiel mis en avant par Bruno Latour : nous ne savons pas où nous habitons, c’est-à-dire que nous ne savons pas de quoi nous dépendons. En cela, décrire est une forme d’action. “Agir” ne doit pas être vu seulement comme le déploiement d’une solution immédiate. Les formes d’action sont nombreuses et la description est aujourd’hui une forme d’action à réhabiliter.

De l’explication, il faut bien tôt ou tard en arriver à la simple description

③ Troisièmement, au même titre que nous aimons croire à des solutions globales, nous devons nous préserver des généralisations. Il serait dangereux de penser que l’on puisse résumer la complexité de situations et de concepts à quelques éléments généraux. Ce type de dynamique nous amène à dire que “tous les … sont comme ça” et nous ancrent dans des clichés. Ces présupposés forment un moule mental dans lequel toute nouvelle chose est forcée. Nous devons à tout prix nous protéger de ces raccourcis car ils détruisent simultanément nos capacités à appréhender la pluralité autant que la singularité. Les voies singulières sont rejetées ou vues comme exceptionnelles, et les voix plurielles sont perçues à travers le moule d’une généralité. Alors que l’ensemble des êtres, humains et non-humains, se retrouve lié aux changements de conditions de vie sur Terre, nous devons aujourd’hui être beaucoup plus attentif à la singularité de phénomènes globaux autant qu’à la pluralité des réponses.

④ Quatrièmement, nous devons apprendre à évoluer dans des situations paradoxales car la situation générale des sociétés humaines aujourd’hui est paradoxale. Ceux qui ont émis le moins de gaz à effet de serre sont et seront les plus touchés par les effets du changement climatique. De même, les savoirs et les instruments qui nous permettent aujourd’hui de comprendre l’urgence climatique sont des co-produits de certains savoirs et des instruments qui ont entraîné la crise environnementale planétaire. Il est plus que jamais nécessaire de changer collectivement et individuellement la façon dont nous vivons. D’une certaine façon, chaque geste individuel est insuffisant et nécessaire. Insuffisant car la transition doit être sociale et systémique, donc bien au-delà de l’échelle individuelle. Nécessaire si les gestes individuels conduisent ceux qui les mettent en oeuvre à renforcer leur conscience politique. Il ne faut pas avoir peur d’évoluer dans des situations paradoxales car elles ne constituent pas une barrière à la réflexion mais au contraire le terrain de jeu de celle-ci.

Ces postures vont au-delà de la question du numérique car il est aussi important de comprendre les principes qui guident ce travail que les informations qui y sont présentées. La complexité des transitions à opérer demande à la fois de la précision et de la précaution et ces quelques conseils peuvent se révéler de précieux compagnons de route.

Définir un cadre : quelle place pour l’Homme sur quelle Terre ?

Anthropocène

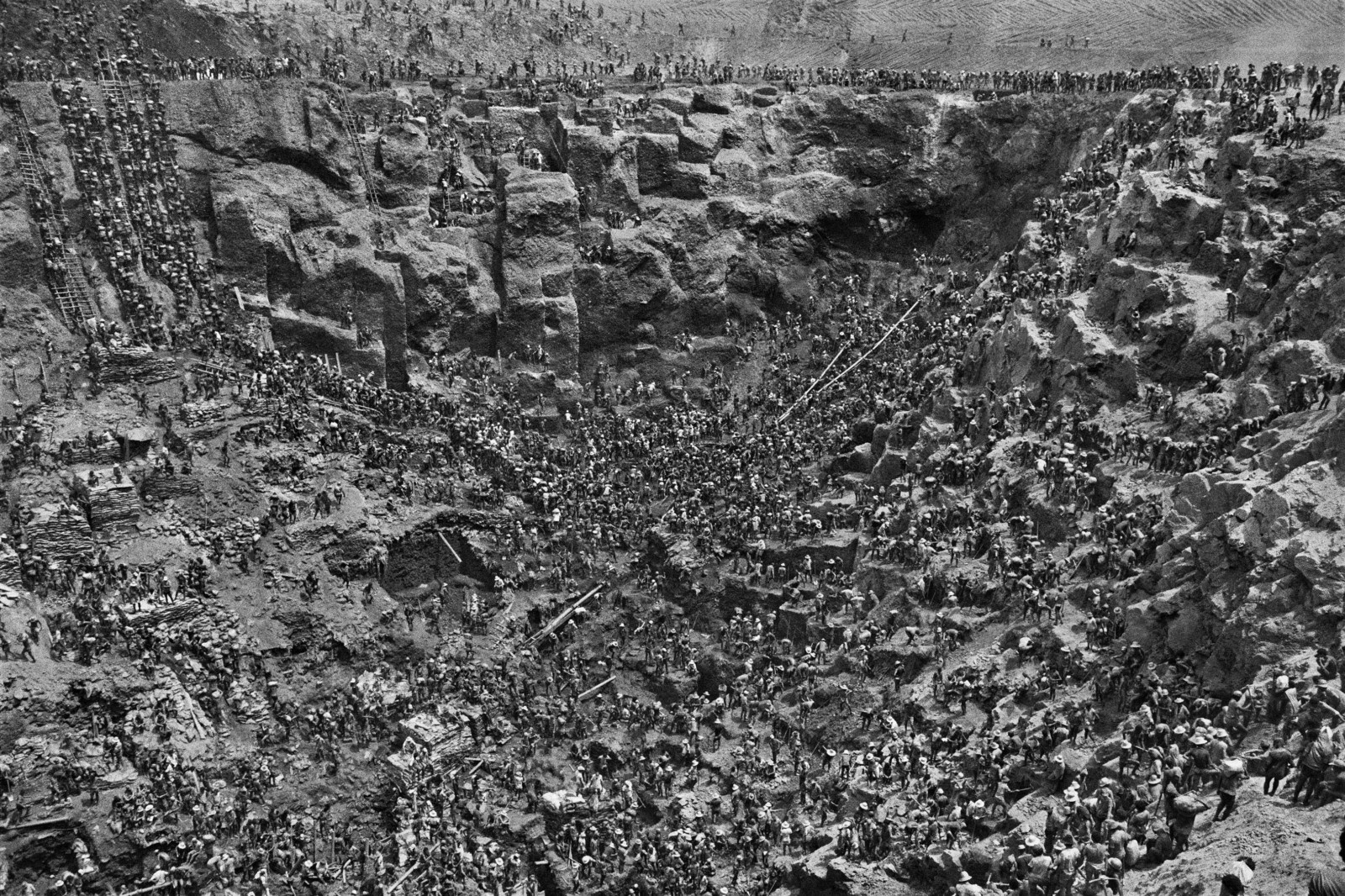

L’anthropocène est un terme utilisé pour indiquer l’empreinte des activités humaines dans le temps géologique et physique de la Terre. Cela veut dire que l’extraction minière, l’utilisation d’énergies fossiles, la déforestation, l’acidification et la pollution des océans sont, entre autres, des marqueurs durables de notre présence sur Terre. Dans les bases polaires, les scientifiques peuvent observer les hausses des gaz à effet de serre liées aux activités industrielles modernes dans les carottes de glaces. Des géologues pourront aussi retrouver des plastiques sédimentés sur l’ensemble de la superficie terrestre, d’ailleurs, ces plastiques sont aujourd’hui appelés “plastiglomérats”.

Les températures moyennes sur le globe terrestre indiquent une tendance à la hausse pour les centaines d’années à venir en raison de nos émissions de gaz à effet de serre (GES) contemporaines. Les océans seront a priori plus chauds, plus acides et plus pollués du fait de plusieurs activités humaines. En effet, les océans captent une partie du réchauffement global et s’acidifient en conséquence. Ces mêmes océans sont aussi pollués depuis les années 1950 par les plastiques et des particules radioactives. Il faut toutefois se rappeler que l’Homme laisse des traces de son activité sur Terre depuis le début de sa vie collective. À titre d’exemples, les indiens d’Amazonie pratiquent la culture sur brûlis et transforment à leur façon la forêt depuis des millénaires, tandis que les ouvrages hydrauliques chinois du premier millénaire ont modifié le flux de leurs grands fleuves comme le Yang-Tsé-Kiang (长江). Une équipe de chercheurs a même pu corréler la présence de plomb dans les glaces du Groenland avec les différents évènements qui ont parcouru l’empire romain. Les périodes de croissance favorisaient la frappe de nouvelle monnaie, dont l’extraction minière d’or et la fonte provoquaient le rejet de plomb dans l’atmosphère. Lors des périodes de crise, la frappe de monnaie diminuait entraînant ainsi la baisse de l’extraction d’or et des émanations de plomb.

Ce qui est en jeu aujourd’hui n’est cependant pas du même acabit. Un observateur extérieur pourrait croire que nous avons mené une expérience radicale de géo-ingénierie pour transformer structurellement l’équilibre d’une planète en deux siècles. L’évolution des cycles planétaires, et de leurs effets locaux, n’est pas problématique en tant que telle, c’est la vitesse du changement et la mise en danger des écosystèmes du fait de certaines activités humaines intensives qui sont aujourd’hui extrêmement problématiques. Les systèmes vivants (faune, flore, insectes, bactéries, etc.) sont mis en tension par des changements climatiques globaux, et, en même temps, sont fragilisés par l’exploitation massive et la pollution de leur habitat. Cette prise en étau est dangereuse, d’autant plus que nous redécouvrons, après deux siècles d’illusions, que nos systèmes productifs dépendent fortement de ces systèmes vivants complexes. On remplacera difficilement des abeilles butineuses par des équivalents électroniques qui demanderont eux-mêmes des minerais, de l’énergie, de l’électronique de pointe, un régime de propriété privée et un abonnement. En se basant sur des critères d’adaptation du vivant et d’habitabilité de la planète à moyen et long terme, on peut dire que la plupart de nos impacts depuis le XVIIIe siècle sont majoritairement négatifs.

Il est extrêmement important de se rappeler que cet état du monde n’est pas le fait de l’humanité vue comme un tout (l’anthropos) ou même d’une quelconque nature humaine qui nous pousserait vers la surexploitation de nos écosystèmes. L’anthropocène est le fait de quelques sociétés humaines définies géographiquement et temporellement : la Grande Bretagne du XVIIIe au XXe siècle, les autres puissances européennes coloniales de la même période (France, Espagne, Portugal, Pays-bas, Allemagne), les États-Unis du XIXe et XXIe siècle, la plupart des pays fortement industrialisés aujourd’hui comme le Japon depuis 1960 et la Chine depuis 1980. C’est pour cette principale raison que certains préfèrent les termes “capitalocène” ou “anglocène” pour bien rappeler la responsabilité historique de certains pays. Cette tension est d’autant plus sensible que les pays qui ont le plus largement profité de l’augmentation des flux de matières et d’énergie (et déporté les pollutions ailleurs), sont aussi ceux qui peuvent le mieux s’adapter, dans une certaine mesure, aux effets du changement environnemental planétaire. Ceux qui ont été les plus exploités seront a priori ceux aussi qui seront les plus vulnérables. Il n’est pas nécessaire de s’imaginer un habitant d’un pays lointain, cette logique s’applique aussi au sein des pays dits “développés”. Sur la côte nord du Pays de Galles, des maisons, à 5 mètres sous le niveau de la mer, sont louées à des familles précaires. Ces personnes n’ont pas accès aux assurances habitation car le risque est trop élevé. Des situations analogues sont observées à Miami, où les foyers riches se déplacent vers les quartiers en hauteur pour se prémunir des futurs risques d’inondation. Ces quartiers étaient traditionnellement laissés aux travailleurs pauvres et face à la pression immobilière, certains de ces travailleurs se retrouvent à habiter dans les zones à risques. Précarité sociale et économique vont généralement de pair avec précarité “climatique” ou environnementale.

Ce qu’on définit par l’anthropocène, le capitalocène, l’anglocène et bien d’autres appellations, associe bien plus que des indicateurs physiques et géologiques. Il donne à voir comment certaines sociétés humaines se sont organisées et ont produit des réalités sociales et matérielles, une certaine idée de la nature humaine, des techniques et de la propriété privée ont sûrement influencé le développement de la Grande-Bretagne au XIXe siècle. Dans la lignée du Royaume-Uni les États-Unis ont eux aussi formulé une certaine idée de la liberté individuelle et d’un mode de vie de consommation de masse. Aujourd’hui, des pays d’Asie, comme la Chine ou l’Inde, entretiennent leur propre idée du développement humain et économique. L’histoire de ces développements est en partie liée à l’usage massif de matières et d’énergies fossiles, impliquant l’exploitation généralisée des écosystèmes. L’idée que se fait une société d’elle-même et du monde ne doit pas être séparée de son abondance matérielle. Ceci est peut-être la première leçon à tirer de l’Anthropocène.

Limites planétaires

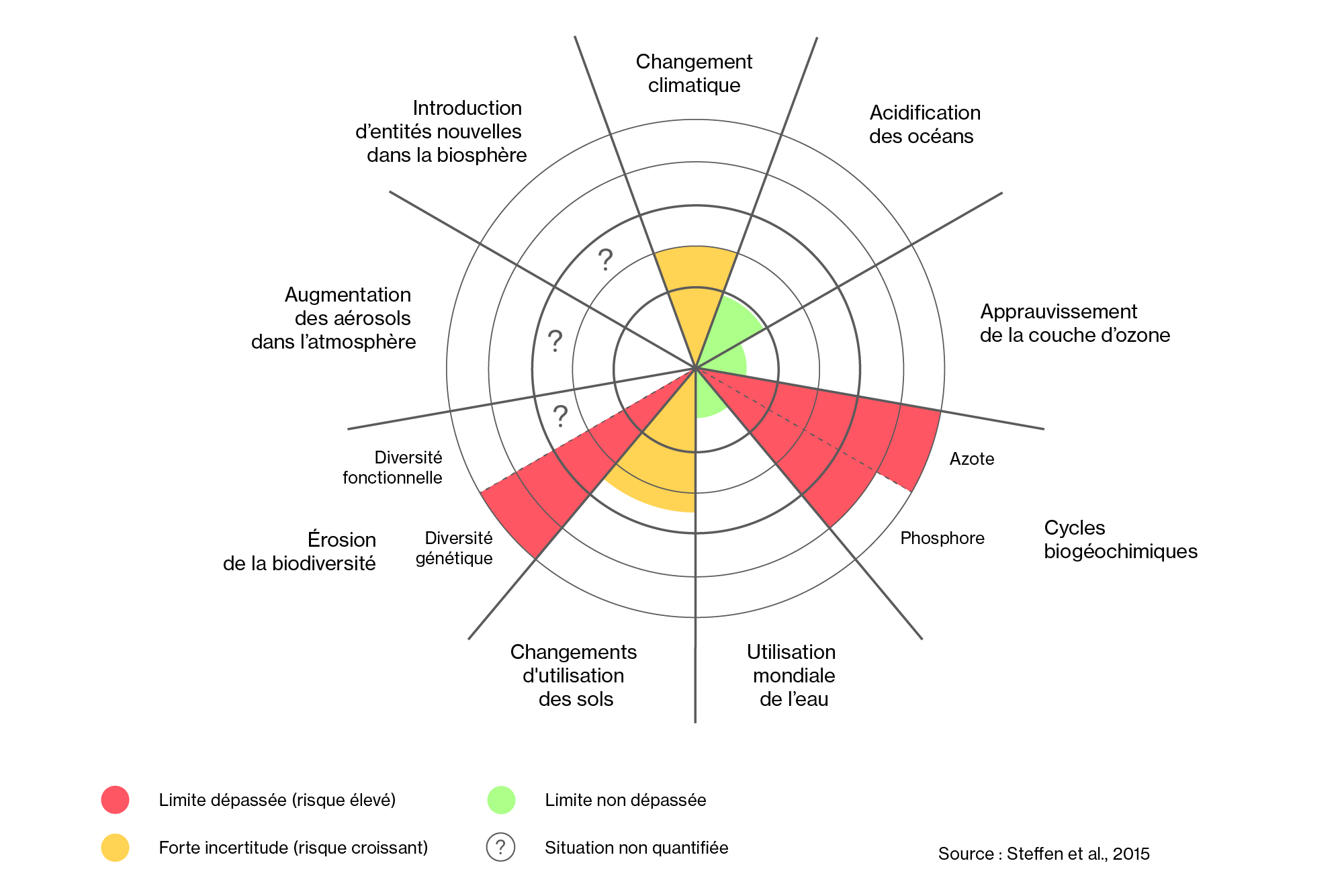

L’Anthropocène est généralement défini par l’extraction et l’usage massif des énergies fossiles, de nouveaux matériaux (plastique, béton, aluminium), une nouvelle donne géologique (déforestation, agriculture intensive, décharges à ciel ouvert, barrages hydroélectriques, forages, excavation minière, etc.), l’usage massif de fertilisants comme l’azote et le phosphore, le réchauffement climatique, l’extinction de masse des espèces vivantes (faune, flore, insectes, bactéries) et la trace de radionucléides liées à l’usage d’armes nucléaires. On peut aussi situer l’observation depuis les neuf limites planétaires identifiées par le centre de résilience de Stockholm en s’appuyant sur les travaux de l’équipe de Will Steffen.

① La première limite est le changement climatique qui est directement associé au réchauffement planétaire. Cette limite observe la concentration de gaz à effet de serre (dont le carbone) dans l’atmosphère, la fonte des glaces aux pôles, le mouvement des systèmes climatiques qui influent sur la température comme El Niño. Cette limite inclut aussi l’apparition de nouveaux risques liés au réchauffement comme la fonte du permafrost en Sibérie qui pourrait relâcher des larges quantités de gaz à effet de serre.

② La seconde limite est l’intégrité de la biosphère, c’est-à-dire la diversité et l’épanouissement des espèces vivantes. La pratique de l’élevage intensif a augmenté la “masse animale” sur Terre mais a drastiquement réduit sa diversité et son rôle dans les écosystèmes naturels. Dans certaines zones sur Terre la biodiversité se dégrade très vite, notamment dans toutes les zones victimes de déforestation. Des habitats d’animaux disparaissent, réduisant leur chance de survie, et des chaînes du vivant se brisent car les sources de nourriture ou d’interaction disparaissent.

③ La troisième limite est directement relié à la deuxième : le changement des systèmes terriens. La destruction de forêts pour la création de monocultures (soja au Brésil, huile de palme à Bornéo par exemple) va au-delà de la disparition d’espèces vivantes. Elle appauvrit des sols qui ne jouent plus leur rôle de retenue des eaux et de capture du carbone, rôle essentiel joué par les forêts par exemple.

④ La quatrième limite est l’usage de l’eau douce et les cycles hydrologiques. L’accès à l’eau douce est primordiale pour les communautés humaines et leurs activités, comme l’agriculture. La modification du cours des rivières et les barrages ont transformé les systèmes hydrologiques, changeant les équilibres environnementaux. De plus, l’augmentation de la température amplifie les sécheresses et le stress hydrique dans de nombreuses régions de la Terre où l’accès à l’eau douce n’est pas une certitude.

⑤ La cinquième limite se situe au niveau des flux biogéochimiques. La transformation des sols par l’agriculture industrielle modifie leur équilibre chimique via l’utilisation massive de phosphore et de nitrogène comme fertilisants. Ces produits deviennent des sources de pollution des sols et des eaux, car ils s’écoulent dans les nappes phréatiques et modifient l’acidité de l’eau. Par exemple les crevettes ont disparu dans certaines zones du golfe du Mexique à cause des fertilisants utilisées dans les fermes américaines et transportés par les rivières jusqu’au golfe.

⑥ L’acidification des océans représente la sixième limite planétaire. Un quart du CO2 émis par l’humanité est dissous dans les océans, modifiant leur chimie et augmentant leur acidité. Ce phénomène met en danger de nombreuses espèces comme le corail, le plancton et les espèces marines à coquilles. Perdre ces espèces entraînerait la baisse des populations des poissons. Depuis la moitié du XIXe siècle, L’acidité de surface des océans a augmenté de 30% et a des implications sur l’ensemble des systèmes planétaires.

⑦ La concentration d’aérosol comme la vapeur d’eau influe sur la formation des nuages et sur les systèmes de circulation atmosphérique, comme la mousson. La concentration d’aérosols change la formation des nuages et donc la quantité de rayonnement solaire absorbée ou reflétée par ceux-ci. Cela influe sur la température de surface de la Terre. De plus, les activités humaines augmentent la concentration de polluants, de poussière et du fumée dans les aérosols, accroissant la toxicité de l’air pour les espèces vivantes dont les humains.

⑧ La couche d’ozone représente la huitième limite car elle filtre la proportion d’ultraviolets traversant la stratosphère pour atteindre la Terre. Une augmentation des U.V. a des effets nocifs sur la santé des humaines et de nombreuses espèces terrestres et marines. La couche d’ozone peut être mis en danger par des gaz comme les hydrofluorocarbures utilisés dans les réfrigérateurs ou les climatisations. Cependant, depuis le protocole de Montréal la concentration de ces gaz s’est stabilisé.

⑨ La neuvième limite caractérise toutes les nouvelles entités chimiques identifiées qui pourraient jouer un rôle sur les cycles planétaires, comme les métaux lourds et les déchets radioactifs. Ces composés peuvent mettre en danger de nombreuses espèces vivantes. Pour l’instant il n’est pas possible de définir précisément un seuil unifié mais les risques qui y sont attachés sont trop importants pour être mis de côté.

Objectifs de transition

En écho aux limites planétaires identifiées précédemment, des objectifs de transition ont été formulés par la communauté internationale. Ces objectifs ont pour but de guider les sociétés humaines vers un mode de vie soutenable, c’est-à-dire un mode de vie qui ne dégrade pas les conditions de vie pour les espèces vivantes (dont humaine) et les écosystèmes sur Terre. Ces objectifs dessinent aussi les contours d’un mode de vie adapté aux nouvelles conditions de vie sur Terre pour les années à venir. Ces nouveaux modes de vie, si nous les atteignons, permettraient en théorie à chacun de vivre dignement et dans le respect des autres cultures humaines et des espèces vivantes.

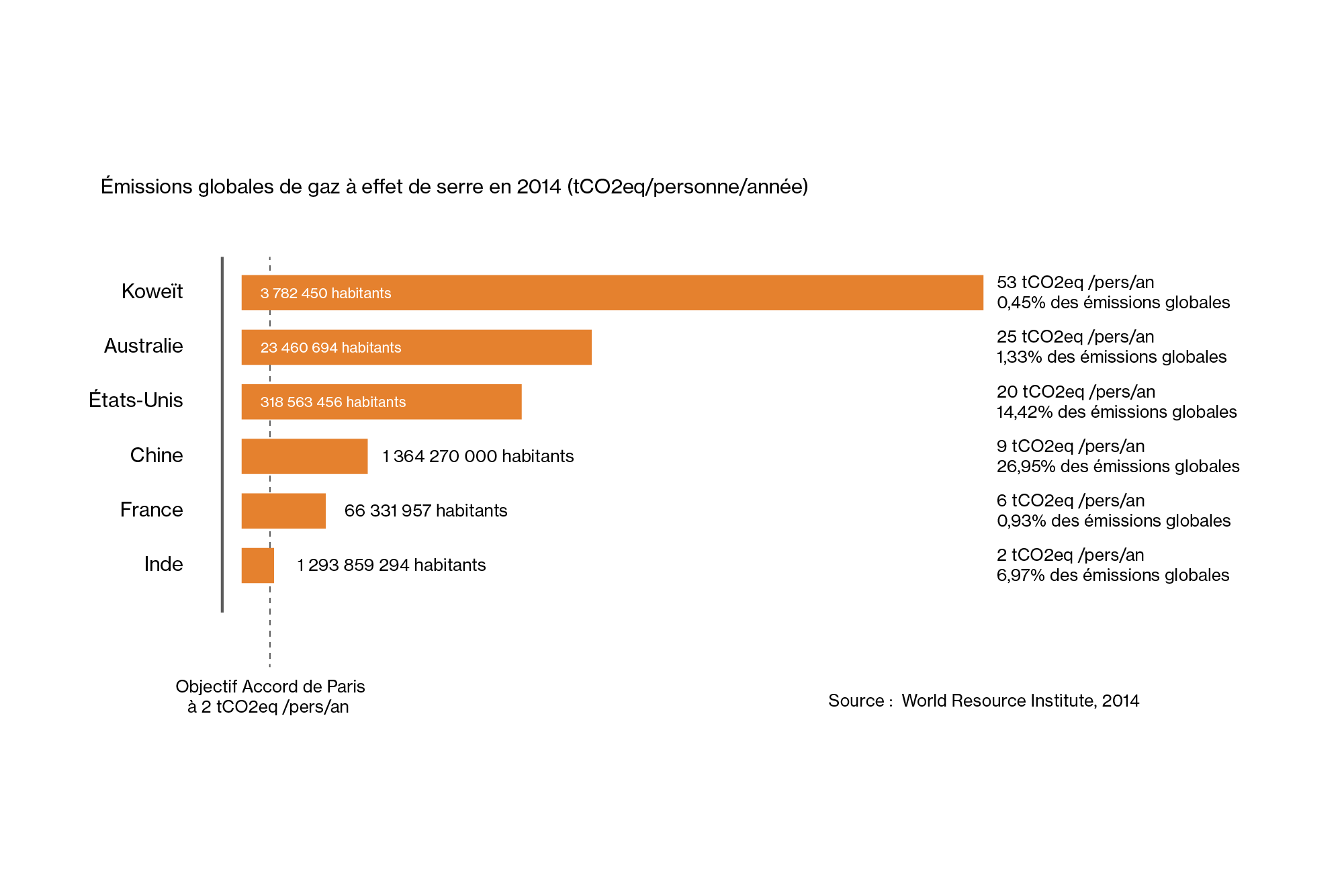

L’objectif le plus connu est celui du seuil des 2°C. Il consiste à réduire et stabiliser les émissions de gaz à effet de serre afin de limiter leur concentration à 480 ppm (parts par million) dans l’atmosphère d’ici 2100. Cet objectif de 2°C indique une température moyenne de surface sur Terre de +2°C par rapport aux niveaux pré-industriels. L’augmentation de la température moyenne globale de +2°C représente un changement considérable au vu de sa rapidité et aura potentiellement des effets hétéroclites partout sur Terre. Certaines régions iront bien au-delà des +2°C, d’autres resteront peut-être en dessous. Pour réduire et stabiliser les émissions de gaz à effet de serre il faut modifier nos modes de vie et s’appuyer beaucoup moins sur les énergies fossiles, dites carbonées. On exprime généralement l’intensité en carbone d’une économie en divisant les émissions annuelles d’un pays par sa population. On appelle cela l’inventaire national et il s’écrit de la façon suivante : tonne d’équivalent CO2 par personne par an (tCO2eq/pers/an). La France se situe à peu près à 6,6 tCO2eq/pers/an en 2014.

Stabiliser la température moyenne globale à 2°C consiste à viser à une moyenne mondiale de 2 tCO2eq/pers/an. Aujourd’hui 80% de la population mondiale est au dessus de cet objectif. Certains de très loin, comme les États-Unis (20 tCO2eq/pers/an en 2014), d’autres pays sont proches de cet objectif mais augmentent leurs émissions au lieu de les réduire comme l’Inde par exemple (2 tCO2eq/pers/an en 2014).

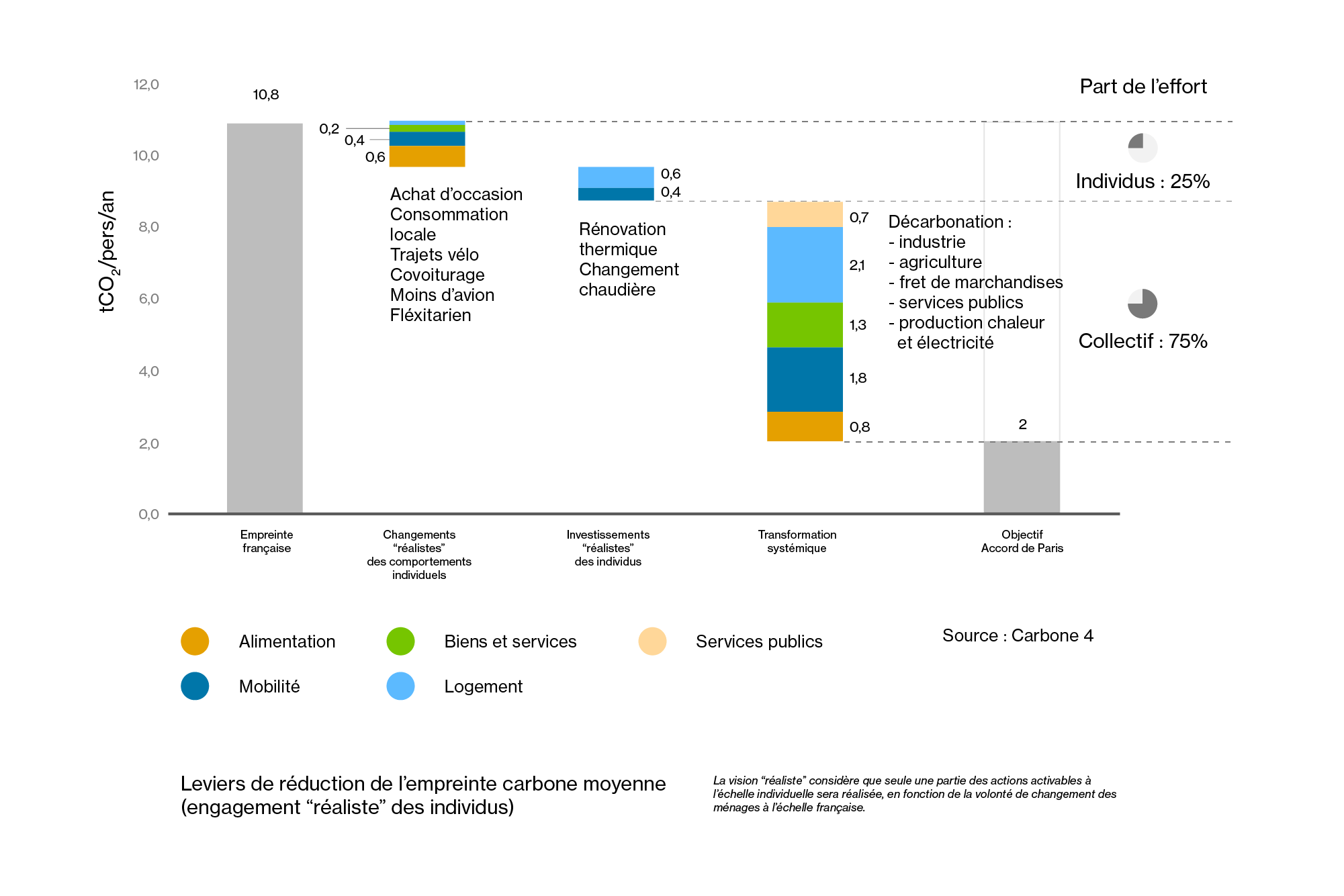

Il faut être attentif à ne pas confondre l’inventaire national et l’empreinte carbone. Contrairement à l’inventaire national, l’empreinte carbone comptabilise les émissions d’équivalent carbone “embarquées” dans tous les produits importés et consommés dans un pays. L’empreinte carbone en France est bien plus élevée que son inventaire car la France importe de nombreux produits “intensifs en équivalent carbone” : 10,8 tCO2eq/pers/an en empreinte carbone en 2014, 6,6 tCO2eq/pers/an en inventaire nationale.

Pour atteindre 0 tCO2eq émis il est nécessaire de capturer autant de carbone que l’on en émet. Cela implique de multiplier les systèmes qui capturent et fixent le carbone, comme les forêts. Atteindre la neutralité carbone ne consiste donc pas à ne plus émettre de gaz à effet de serre mais consiste plutôt à compenser toutes ses émissions. Il faut toutefois nuancer ces objectifs avec la réalité chimique du carbone. Une molécule de CO2eq qui serait émise aujourd’hui par un pot d’échappement de voiture mettra entre 10 et 30 ans à atteindre son effet réchauffant maximum dans l’atmosphère et entre 50 à 10 000 ans à disparaître de l’atmosphère. Le réchauffement actuel est le résultat d’émissions datant de plus de 20 ans en moyenne et une partie du carbone émis depuis le début de la révolution industrielle mettra 10 000 ans à s’épurer de l’atmosphère. L’anthropocène et ses facteurs (réchauffement, etc.) n’est pas une crise avec un retour à la normale possible. C’est un changement durable des conditions de vie sur Terre.

L’objectif de 2°C s’adresse directement au réchauffement planétaire lié aux émissions de gaz à effet de serre. C’est un accord planétaire établi pour modifier nos modes de vie et nous adapter en partie aux limites planétaires. Cependant une décrue de nos émissions de gaz à effet de serre implique une transformation sociale et technique de grande envergure : changer notre agriculture, notre production d’énergie, nos modes de transport, etc. Mais dans cet objectif de transition socio-technique quelle part revient au changement individuel et à quelle part revient à la transformation de systèmes ? Le cabinet Carbone 4 a estimé qu’un changement de comportement réaliste d’un individu (flexitarien, co-voiturage, rénovation thermique, etc.) ne représenterait que 25% du chemin à accomplir, les 75% restants se situraient au niveau de changement systémique : décarbonation des transports, de l’industrie, etc.

Il faut retenir de cette première estimation que l’action individuelle (changement de comportement) doit s’accompagner ou être mise en mouvement par des changements systémiques. Il semble injuste et inefficace de focaliser l’ensemble de l’effort de transformation au niveau des individus. La logique de “responsabilisation des usagers/consommateurs” sert parfois de défausse à des entreprises qui n’entreprennent pas de transformation au sein de leur organisation. Par exemple, il sera hypocrite pour un opérateur de télécommunications de vouloir “responsabiliser” ses usagers sur les impacts environnementaux de leur consommation numérique tout en continuant à proposer des renouvellements de téléphone à 1 € et des forfaits illimités. En ce sens, les changements de comportement qu’effectuent les citoyens d’un pays doivent servir d’appui pour réclamer la transformation des organisations qui pourrait représenter 75% du chemin à parcourir.

Mise à part le protocole de Montréal pour la couche d’ozone et l’accord de Paris nommé précédemment, il n’existe pas aujourd’hui d’autres accords mondiaux sur des objectifs de transition précis. Chaque pays ou fédération établit ses propres objectifs. L’Union Européenne a par exemple 6 objectifs de protection de la biodiversité. Les Nations Unis ont proposé des Objectifs de développement durable (ODD) qui touchent à certaines limites planétaires et reprennent une partie des objectifs de l’accord de Paris, toutefois ces objectifs sont assez vagues et laissent libre champ à l’interprétation et aux choix des données présentées.

Les accords planétaires non contraignants ne garantissent pas un respect des objectifs. Les émissions globales d’équivalent CO2 ont continué à augmenter depuis l’accord de Paris et les États-Unis se sont officiellement retirées de l’accord sous la présidence de Donald Trump. En 2020, certaines limites planétaires sont déjà largement dépassées et plusieurs autres limites sont en bonne voie pour être dépassées dans les années qui viennent. La communauté scientifique multiplie les alertes sur tous les indicateurs et appelle à une coopération internationale pour faire advenir des modes de vie soutenables à moins de 2 tCO2eq/pers/an. Cependant il ne faut pas tout réduire à ce seul objectif, certains pays sont sous cette barre mais connaissent une grande précarité et doivent continuer leur développement, tout en considérant d’autres façons de se développer. Pour d’autres pays, notamment occidentaux, l’écart à franchir est très important et la multiplication de régimes autoritaires peut représenter un frein à la transition et au projet démocratique qui doit y être attaché. Le défi politique des transitions consiste à opérer une décrue de la consommation globale de ressources et d’énergie tout en maintenant l’intégrité des structures démocratiques qui assurent et formulent des droits et des libertés individuelles et collectives.

Matérialiser le numérique : quelles infrastructures et quels impacts ?

Comprendre l’infrastructure du numérique

Deux mythes

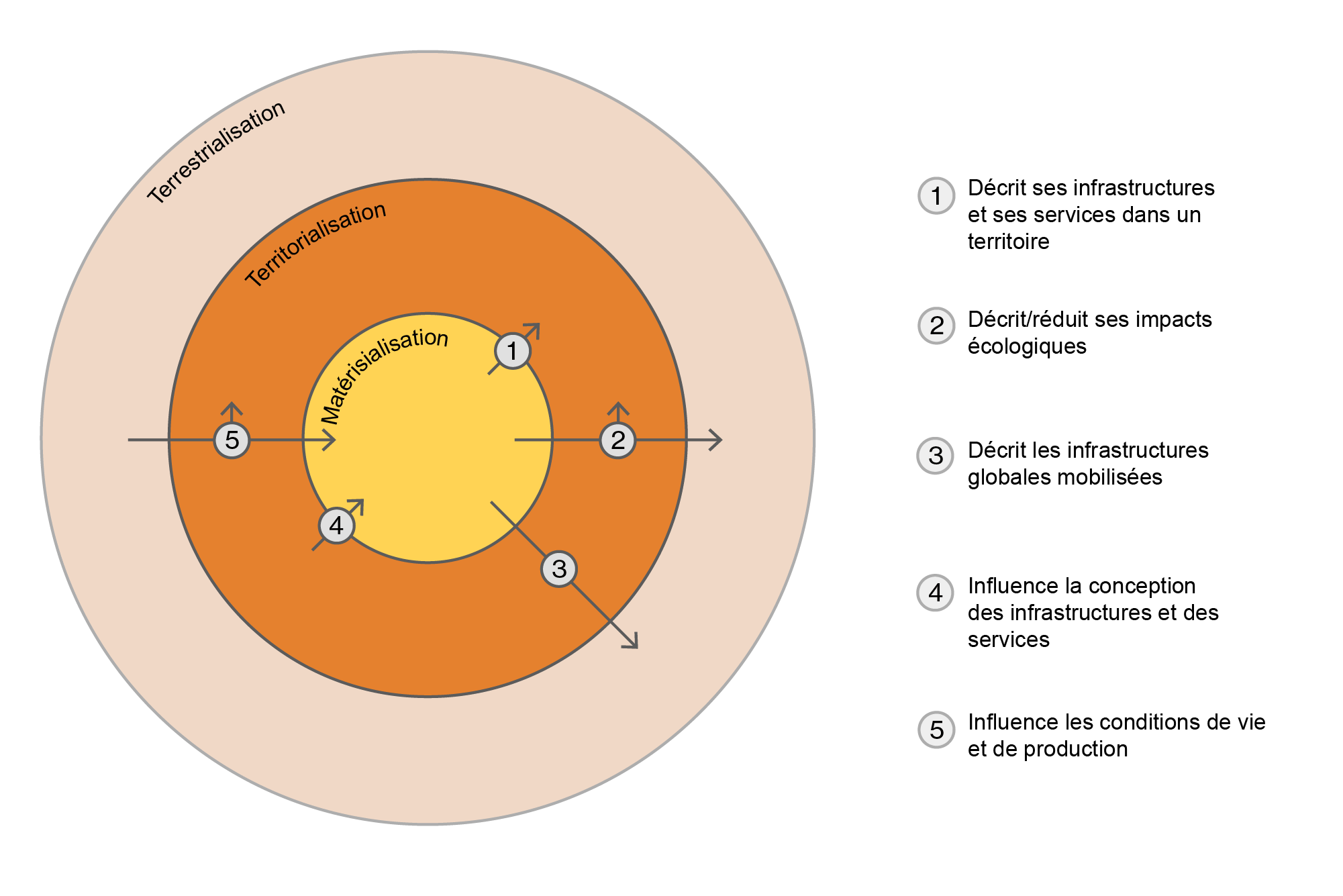

Il est important de définir le cadre dans lequel évolue le numérique car cela renverse la façon dont nous examinons traditionnellement son infrastructure et ses services. Les acteurs du secteur cherchent à montrer quel monde idéal est possible grâce au numérique. Les campagnes de promotion, les rapports, les scénarios produits aujourd’hui vont généralement dans ce sens. Des titres promotionnels comme “le futur de la mobilité grâce à l’IA”, “le monde sans limites de la 5G” ou incluant les mots “intelligent”, “smart”, “futur”, “connecté”, sont des exemples parmi d’autres de ce phénomène. L’avantage d’une telle position est qu’elle permet de décrire un monde simplifié depuis des technologies numériques en s’affranchissant des contraintes matérielles et écologiques. En définissant le cadre terrestre, ainsi que des objectifs et contraintes à court, moyen et long-terme, nous pouvons alors retourner la proposition initiale. Plutôt que de savoir quel monde est possible grâce au numérique, cherchons plutôt à comprendre quel(s) numérique(s) est(sont) possible(s) sur la Terre que nous voulons de définir.

Passer de “quel monde est possible grâce au numérique” à “quel numérique est possible dans ce monde”.

Le numérique, tel que nous le définissons aujourd’hui, s’est développé dans la société civile à partir des années 90. Lorsque le numérique est proposé comme une offre commerciale grand public deux discours l’accompagnent : la dématérialisation et le “village global”. Premièrement, il semble a priori qu’aucune autre infrastructure globale n’ait été présentée comme “dématérialisée” avant. De ce point de vue, l’infrastructure numérique est un cas unique dont il faut prendre toute la mesure. Toute infrastructure est matérielle, par contre elle peut être camouflée par différents choix politiques, techniques, sociaux et économiques, et par différents choix de conception. Ce camouflage revient à “dématérialiser” un service courant (courrier) et à la “rematérialiser” loin de l’usager (email). L’envoi d’un courrier par la poste demande d’écrire sur une feuille de papier, d’avoir une enveloppe et un timbre et d’aller à la boîte aux lettres. Le courrier sera récupéré par un facteur en vélo ou en fourgon, amené à un centre de tri et livré à destination par un autre facteur. Cette opération nécessite de l’engagement personnel (écrire, achat papier/enveloppe/timbre, déplacement), des moyens de transport (fourgon de la poste), des lieux (boite aux lettres, centre de tri), de l’énergie (essence du fourgon, électricité du centre et chauffage). L’envoi d’un email nécessite une box, du cuivre, de la fibre dans les rues, des tableaux d’accès, des centres de données, des antennes, des ordinateurs et sûrement des smartphones. Cette opération nécessite peu d’engagement personnel (écrire), des moyens de transport (camion pour maintenance et travaux), de l’énergie (électricité des équipements utilisateurs, centres de données, climatisation, etc.).

Le “numérique” est donc bien une infrastructure matérielle sauf que son développement a plutôt eu tendance à la rendre invisible. Peu d’entre nous ont vu ou visité un centre de données ou savent repérer une antenne 4G. Dans notre quotidien, les seules choses qui nous lient à cette infrastructure sont principalement nos appareils personnels ou professionnels (ordinateur, smartphone, objets connectés) et nos box internet.

Ce processus de camouflage a été aussi lié au concept de “village global” qui sous-entendait que l’instantanéité des communications mondiales allait mener à l’émergence d’une culture globale. Puisqu’une partie croissante de l’humanité allait pouvoir échanger des informations, certains penseurs, chefs d’entreprise et investisseurs supposaient qu’une culture mondiale allait se développer. Ce principe présumait que les cultures pouvaient se détacher de leurs territoires et se mélanger dans un espace sans distance nommé “village global”. Cela repose sur une idée de la culture vue comme un concept immatériel, pourtant une culture repose sur des éléments bien matériels et des territoires spécifiques : les cuisines, les paysages, les langues, les corps, les musiques, les animaux, les plantes, l’architecture, etc. De plus, si nous imaginons que nous partageons tous le même espace cela détourne notre attention sur l’espace physique et géographique où est déployé l’infrastructure et les impacts de celle-ci sur des espaces réels (évacuation de chaleur des centres de données, utilisation d’eau, exploitation minière, etc). Les usages “majeurs” (mainstream) de cette infrastructure ont été largement pensé dans une logique universelle où le numérique est un drap de services et de solutions qui vient se déposer uniformément sur tous les territoires, quelque soit leurs spécificités et leurs besoins. Ainsi peu de services numériques majeurs ont été pensés depuis les besoins des zones rurales et périphériques. Ces territoires sont généralement les derniers à être recouvert par le “drap” du numérique. Finalement, un “village global” ne définit aucun territoire géographique, il est donc possible en son sein de faire vivre le concept de la “dématérialisation” et de l’étendre à d’autres termes nébuleux comme le cloud (serveur distant). Ces deux concepts sont aujourd’hui des mythes plus que des descriptions pertinentes de cette infrastructure.

Décrire une infrastructure

L’histoire du numérique est avant tout l’histoire de la mise en place et du développement d’une infrastructure. Sa mise en place nécessite la coopération de forces politiques, industrielles, financières, scientifiques et sociales. En effet, une infrastructure n’est jamais “que” technique, elle est aussi sociale, c’est-à-dire qu’elle mobilise a minima des acteurs sociaux et politiques.

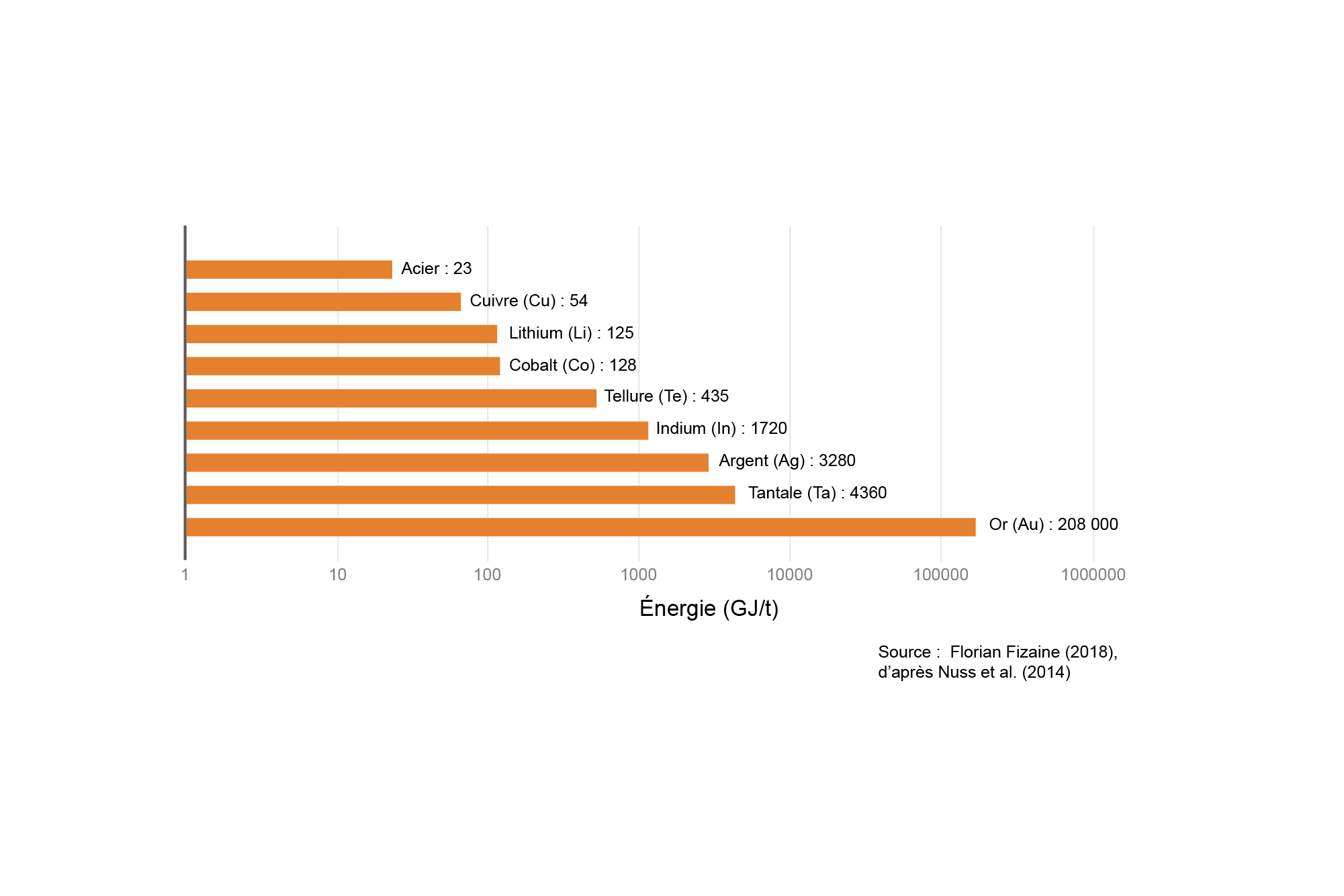

L’infrastructure numérique est enchevêtrée dans de nombreux phénomènes. Dans un premier temps, des “ressources” sont nécessaires, nous avons donc besoin de transformer de la matière en marchandise, c’est-à-dire une matière soumise au régime de propriété privée et qui est liée à un coût de production et à un prix sur un marché. De quelles ressources avons-nous besoin ? Une cinquantaine de métaux dont certains en très grande quantité; de l’énergie pour l’extraction, le transport, la transformation; et différentes matières premières, par exemple, du caoutchouc pour l’enrobage des câbles. Des mines et des plantations doivent donc être déployées ou sollicitées. Cela implique des savoirs scientifiques d’exploration d’un territoire pour quantifier les réserves souterraines des sols, une politique de privatisation des terres négociée avec des gouvernements locaux ou nationaux, l’intégration d’un droit du travail spécifique aux mineurs, des législations et des normes sanitaires et environnementales plus ou moins strictes en fonction des pays, le recrutement de la main d’oeuvre et donc des recruteurs, la mise en place de chaînes d’approvisionnement du matériel et la préparation du terrain à exploiter. Au final, comme presque toutes les infrastructures modernes, le numérique commence dès l’exploration minière des sols et leur préparation.

Dans un second temps ces ressources nécessitent d’être transportées et transformées. Le transport s’opère par camions et par bateaux. Ce processus s’inscrit donc dans des systèmes logistiques qui incluent droits maritimes, ports, travailleurs, douanes, syndicats, approvisionnement énergétique (fuel et kérosène pour les cargos). Les ressources acheminées doivent ensuite être transformées en matériaux qui serviront à la création de composants électroniques : purification et fonte du cuivre, de l’or, du platine, des métaux rares, etc. La production de certains composants cruciaux pour le numérique mobilise des capitaux et des savoirs titanesques, liant enjeux géopolitiques et monopoles économiques.

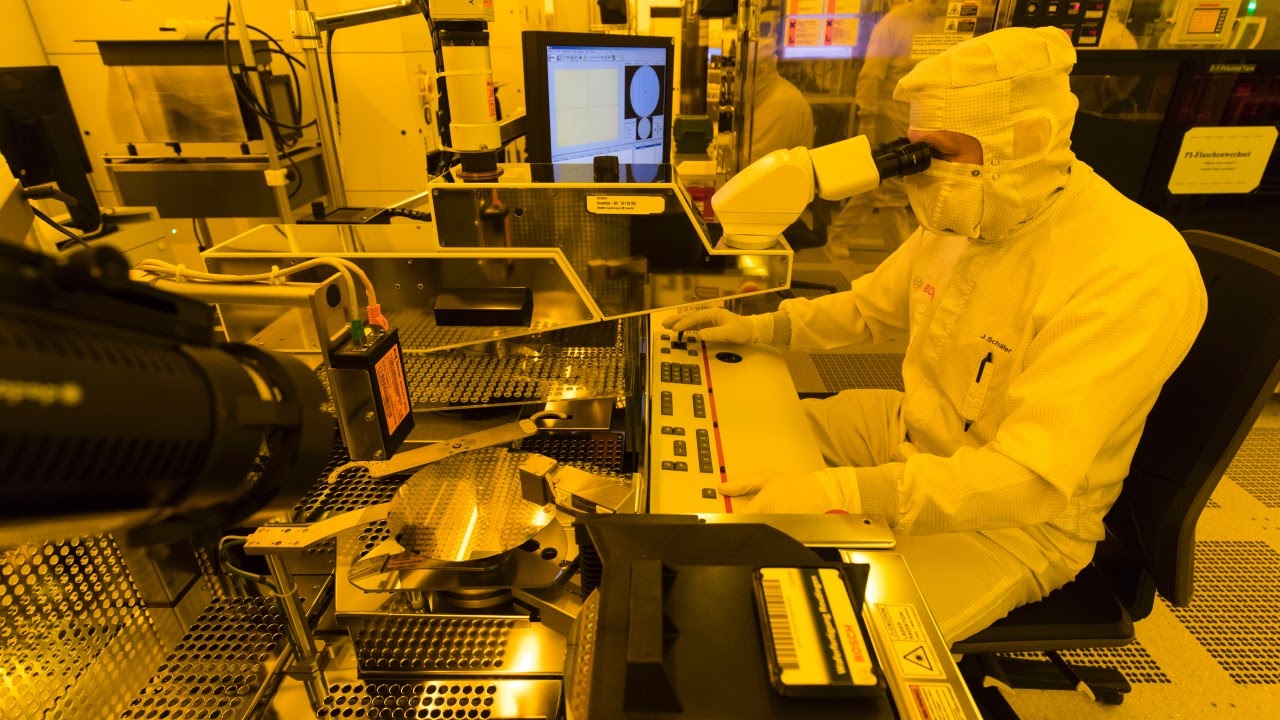

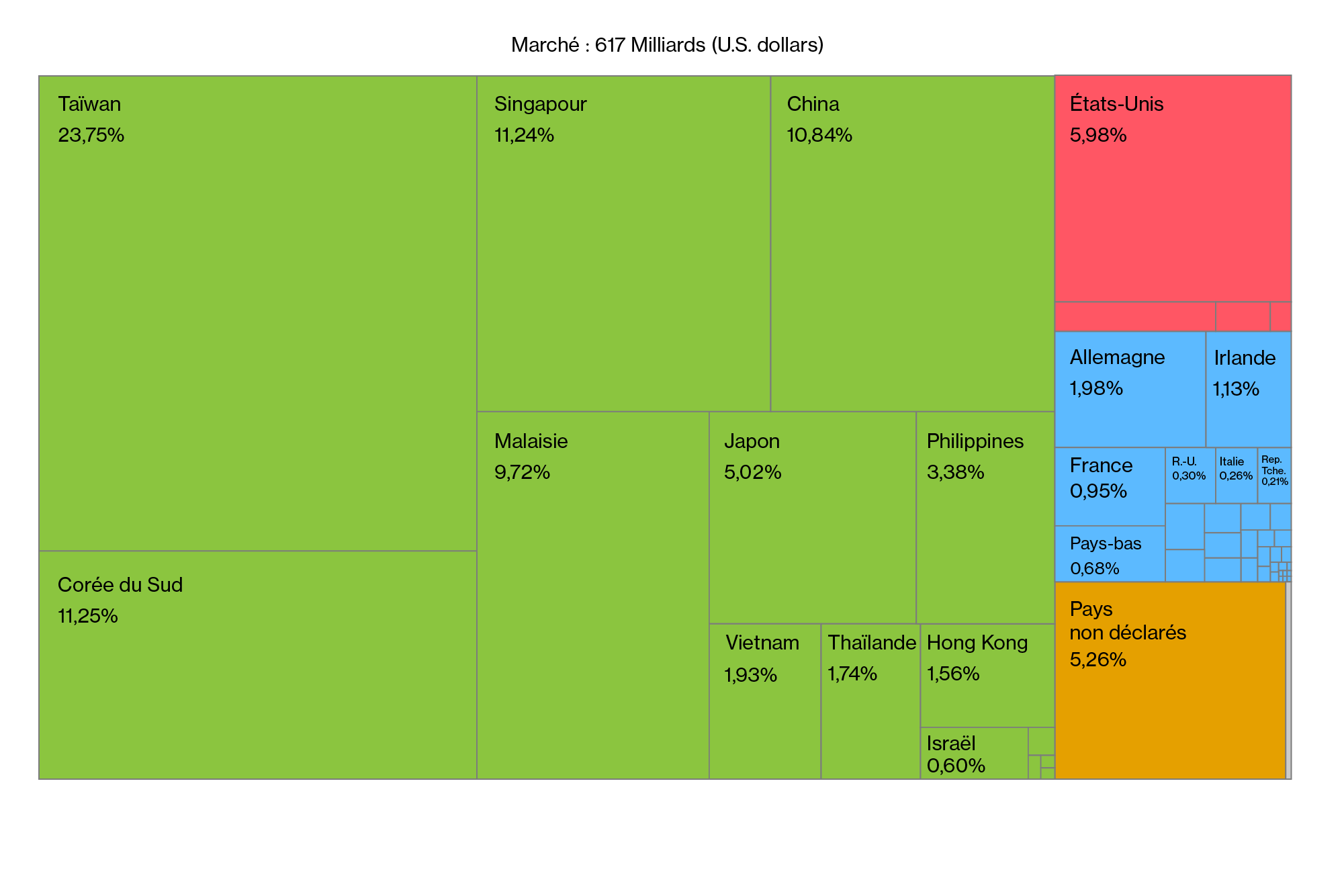

Par exemple, la production des semi-conducteurs, composants fondamentaux de toute l’infrastructure numérique et de ce qu’on appelle la high-tech, est structurée autour de pays et de groupes bien particuliers. Certaines entreprises conçoivent les puces (fabless), d’autres les fabriquent (fab), certains font un peu des deux (IDM, pour Integrated Device Manufacturer), comme Intel par exemple. Il y a aujourd’hui trois fabricants principaux (les fab) : TSMC (Taïwan), GlobalFoundries (U.S.A.) et UMC (Taïwan). L’infrastructure numérique n’existerait pas aujourd’hui, ou telle qu’elle se pense demain, sans eux et leurs chambres blanches anti-vibrations où sont gravées des feuilles de semi-conducteurs. Il est très probable que chaque objet numérique autour de vous ait un ou des composants intégrants leurs semi-conducteurs. L’électronique et le numérique, n’existeraient pas sans ces composants et l’industrie qui les produit, notamment à Taïwan et aux États-Unis.

Ce composant de quelques millimètres est l’enchevêtrement de savoirs scientifiques, de savoirs législatifs et juridiques, de forces politiques, d’intérêts financiers et de stratégies de développement économique. Ceci nous montre bien que n’importe quelle infrastructure dépasse le simple descriptif “technique”. Un exercice global a été mené par Kate Crawford and Vladan Joler pour déterminer tous les systèmes impliqués dans la fabrication, l’usage et le traitement en fin de vie d’un Amazon Echo.

La cartographie qui en résulte, “Anatomy of an AI System”, témoigne bien de la complexité du numérique.

Les centres de données

Les données numériques sont distribuées et stockées dans des centres de données à travers le monde. Ces centres peuvent être décrits comme de grands entrepôts, généralement situés en zone périurbaine, proches des lignes d’approvisionnement électrique et des grandes lignes de passage de la fibre. Ces entrepôts hébergent des rangées de serveurs qui stockent, calculent ou transfèrent des données. On y trouve aussi des équipements réseaux pour les opérateurs télécom et pour l’interconnexion avec les autres centres et réseaux. Les centres de données utilisent de l’électricité pour alimenter les serveurs, refroidir les salles et pour toutes les opérations annexes du centre (éclairage, surveillance, etc.)

Il existe quatre grands types de centre de données :

- Les centres de données d’exploitation, directement placés dans les entreprises et les administrations qui opèrent leurs propres serveurs;

- Les centres de données commerciaux (hébergement/colocation), qui hébergent les serveurs d’autres entreprises ou mettent à disposition leurs serveurs en fonction des besoins de leurs clients, à travers le cloud par exemple;

- Les centres de données “Hyperscale”, qui sont des centres de données géants opérés principalement par les géants du numérique comme les GAFAM (Google, Apple, Facebook, Amazon, Microsoft);

- Les centres de données “High Power Computing” (HPC), qui sont des centres ultra-performants utilisés pour la recherche scientifique.

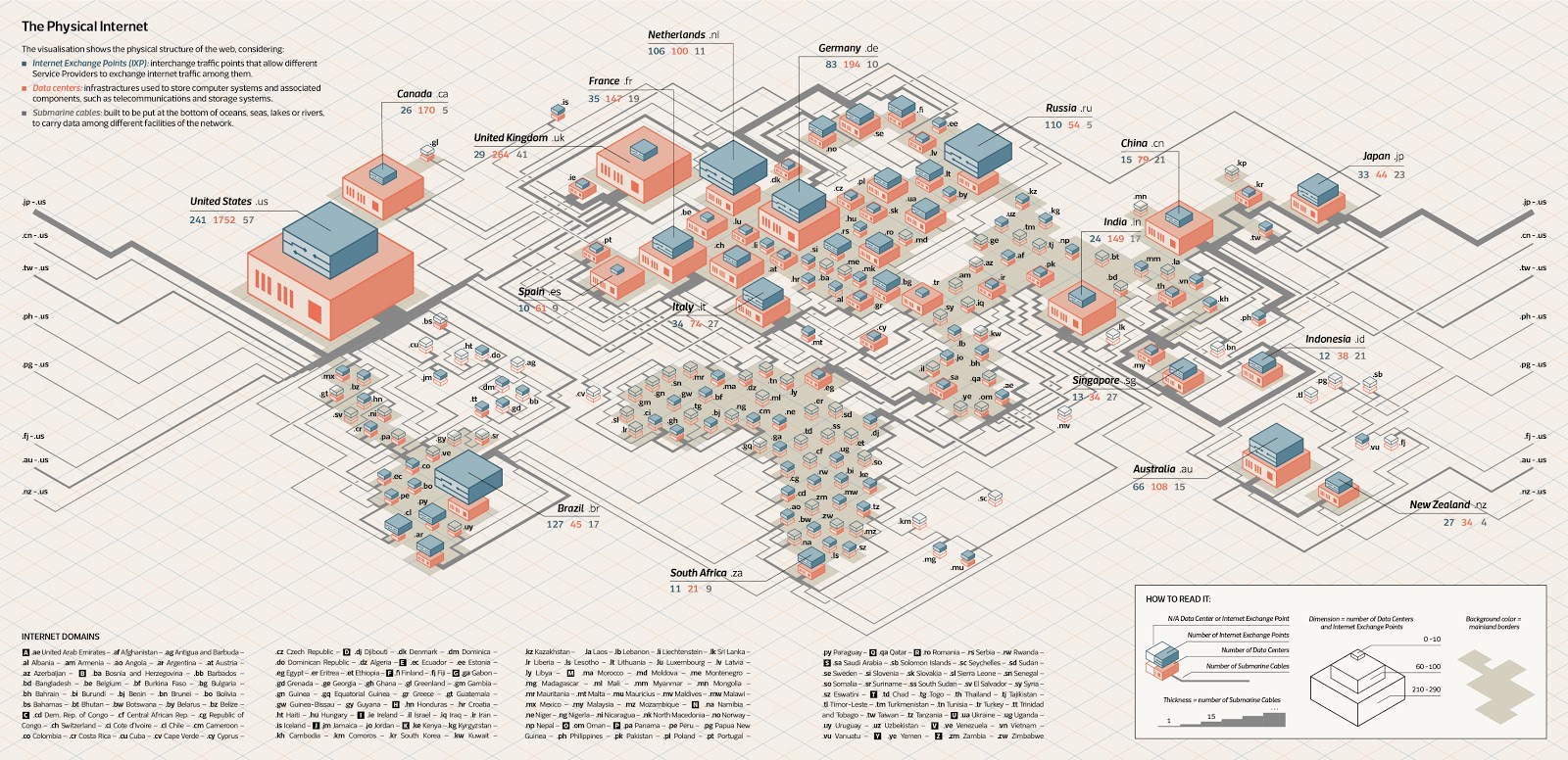

Ces centres de données ne sont pas répartis de façon homogène sur l’ensemble des territoires. Cela dépend bien évidemment du niveau de numérisation d’un territoire donné, de ses capacités d’investissement, des enjeux financiers et politiques inhérents à cette infrastructure. Par exemple, les centres de données en colocation en 2018 sont au nombre de 2208 aux États-unis, 419 au Royaume-Uni, 262 en France, encore moins en Chine et en Russie. Les États-Unis possèdent une infrastructure numérique colossale pour ce qui est des centres de données. De fait, beaucoup de données du monde entier transitent par ceux-ci, avec tous les problèmes que cela pose en termes de sécurité, de monopole et de gouvernance des données. Cependant certains acteurs, comme la Chine, possèdent des centres de données beaucoup plus grand mais disposent a priori d’une offre de colocation moins large.

Un centre de données a besoin d’un espace, existant ou à construire, pour s’installer. À Paris les anciens bâtiments de l’industrie textile sont populaires car leur structure métallique peut supporter le poids des serveurs et des équipements réseaux. L’autre option consiste à construire un centre de données grâce à un permis de construire délivré par les autorités compétentes. Le choix de l’emplacement dépend de deux facteurs principaux : l’approvisionnement électrique et la connectivité. En France les centres de données sont généralement répartis autours des postes de distribution de ENEDIS ou parfois de RTE. Il arrive aussi que les opérateurs de centres de données construisent leurs propres postes de distribution électrique afin de se raccorder au réseau.

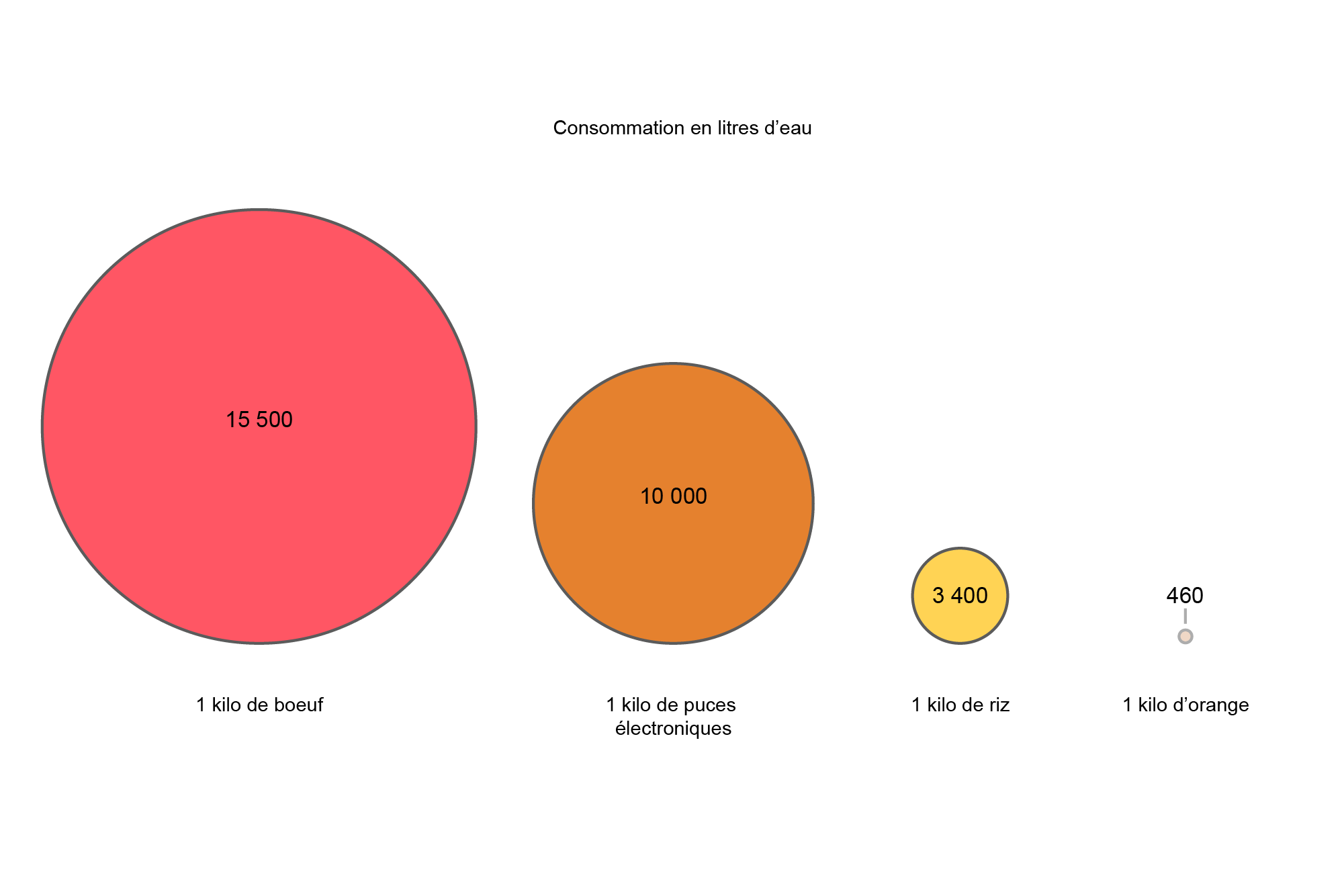

Pour assurer leur connectivité (vitesse, redondance et qualité du réseau), les centres de données sont aussi installés près des dorsales d’internet, c’est-à-dire les axes principaux du réseau internet. Les centres de données de “Plaine Commune” ont été installés dans le nord de Paris car ils sont idéalement situés le long du réseau électrique et par rapport à un grande axe de connectivité d’internet qui longe l’A1. Les nouveaux centres de données de Saclay se situent aussi près d’une dorsale le long de l’A10. Il n’existe cependant pas de carte officielle des dorsales d’internet en France notamment pour des raisons de sécurité. Au-delà de l’électricité et de la connectivité un centre de données peut aussi avoir besoin d’eau pour son refroidissement. Les gestionnaires californiens de centres de données indiquent que certains de leurs centres peuvent utiliser jusqu’à 1 600 000 litres d’eau par jour pour leur refroidissement. La plupart des centres de données disposent également de générateurs et de cuves de fioul pour anticiper une coupure d’alimentation.

L’arrivée d’un centre de donnée sur un territoire n’est donc pas anodine, elle correspond à un choix minutieux d’approvisionnement électrique et de connectivité afin de réduire les coûts et assurer la fiabilité du service. Une fois installé, un centre de données réserve une partie de la puissance électrique d’un territoire, parfois une partie d’un flux d’eau en même temps qu’il rejette plus ou moins de chaleur et influence le marché foncier. Tous ces phénomènes sont bien souvent invisibles au grand public mais les impacts électriques, matériels, environnementaux et fonciers de cette partie de l’infrastructure sont bien réels.

Les “Points d’Échange Internet” (IXP)

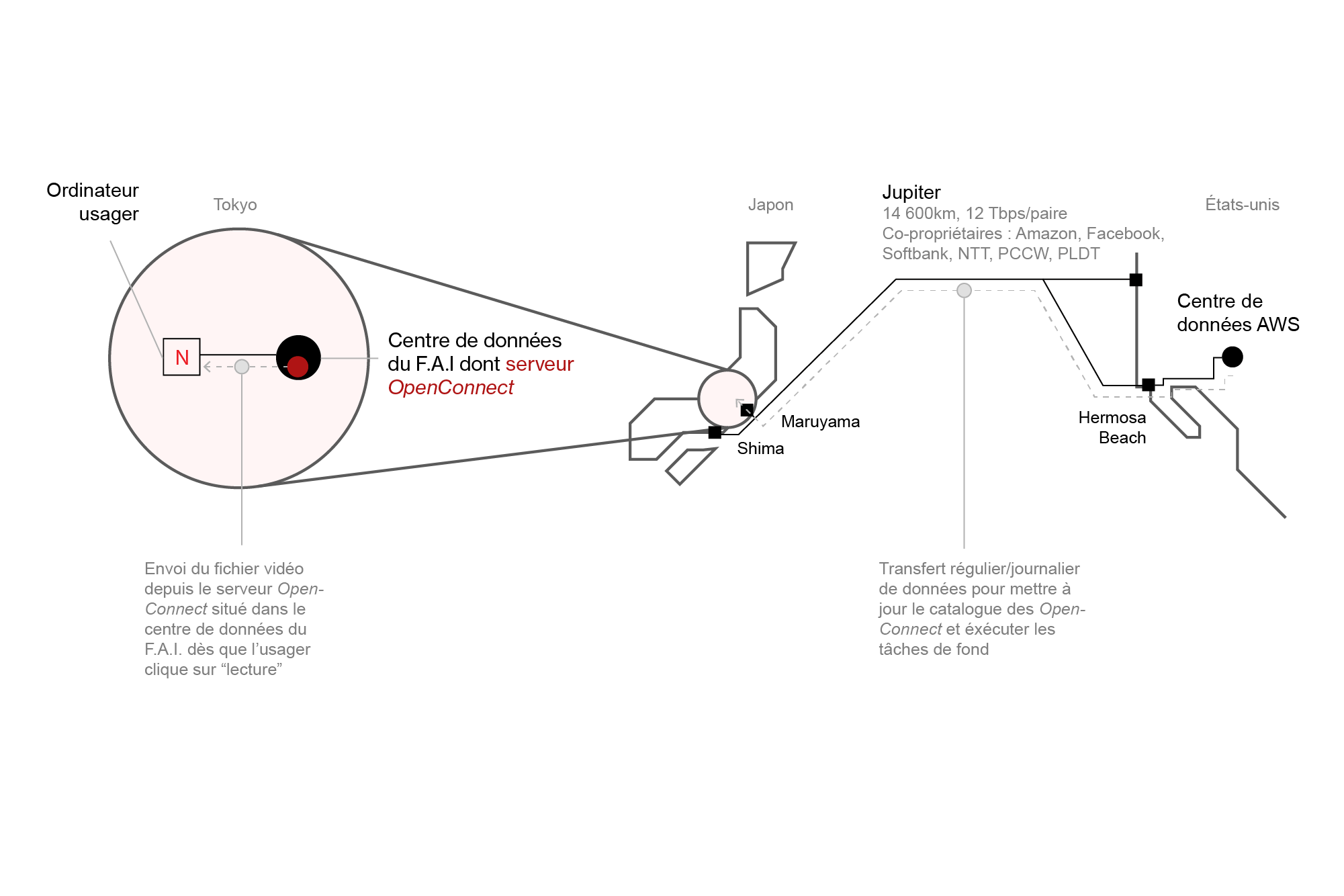

Pour faire transiter les flux de données entre les différents réseaux (fournisseurs d’accès internet, fournisseurs de services, etc.) des “Points d’Échange Internet” (Internet eXchange Points ou IXP) servent de carrefours et de raccourcis. Ces points sont cruciaux car ils permettent des interconnexions directes entre les différentes acteurs du réseau, évitant aussi de faire allers/retours complets d’un centre de données à l’autre. À l’échelle individuelle, c’est le fournisseur d’accès internet (FAI) qui permet à son client d’avoir accès au réseau internet. En théorie, un client particulier passe toujours par le centre de données de son FAI pour accéder au contenu souhaité stocké sur un autre serveur distant. Pour réduire cette distance les “Points d’Échange Internet” permettent des interconnexions d’un réseau à l’autre sans passer obligatoirement par les centres de données des fournisseurs d’accès et les plus grands centres de distribution du trafic. Cela permet aussi aux fournisseurs d’accès internet de transférer directement leur trafic d’un réseau à l’autre.

Une entreprise distributrice de contenu intègre un IXP pour ouvrir une ligne directe vers son réseau, plus il y a d’entreprises participent à un IXP plus le nombre d’interconnexions directes augmente et le réseau gagne en rapidité et en fiabilité tout en réduisant les coûts. Les coûts d’exploitation d’un IXP sont généralement mutualisés entre les sociétés qui intègrent la structure. Le “Point d’Échange Internet” “Paris IX” compte par exemple plus de 300 membres de toute taille comme Apple, Blizzard, Arte, Blablacar, Bouygues, Orange, etc. Avoir ces raccourcis entre les différentes centres de données permet de réduire la latence, la bande passante et les coûts car la donnée voyage moins loin et mieux. Le but d’un IXP est de garder le trafic local à l’échelle locale (keeping local traffic local).

Au même titre que les centres de données, la distribution des IXP n’est pas homogène en fonction des géographies et des réseaux : les États-Unis en comptent 241 sur leur territoire, 35 pour la France et 106 pour les Pays-bas. Les modèles économiques changent radicalement en fonction de ces régions, les IXP nord-américains sont généralement des sociétés à profit alors que la scène européenne s’est structurée autour d’un modèle à but non lucratif. De ce fait les IXP européens fournissent des données plus précises et plus ouvertes que leurs homologues nord-américains.

Les Points d’Échange Internet proposent un tissu d’interconnexions de plus en plus dense qui rivalise avec les centres de données des fournisseurs d’accès internet qui fournissaient traditionnellement ce service. Les IXP sont des composants essentiels d’Internet souvent sous-estimés. Leur présence permet d’optimiser le transfert de données et d’économiser les coûts électriques et financiers du transfert de données sur les réseaux.

Les câbles sous-marins

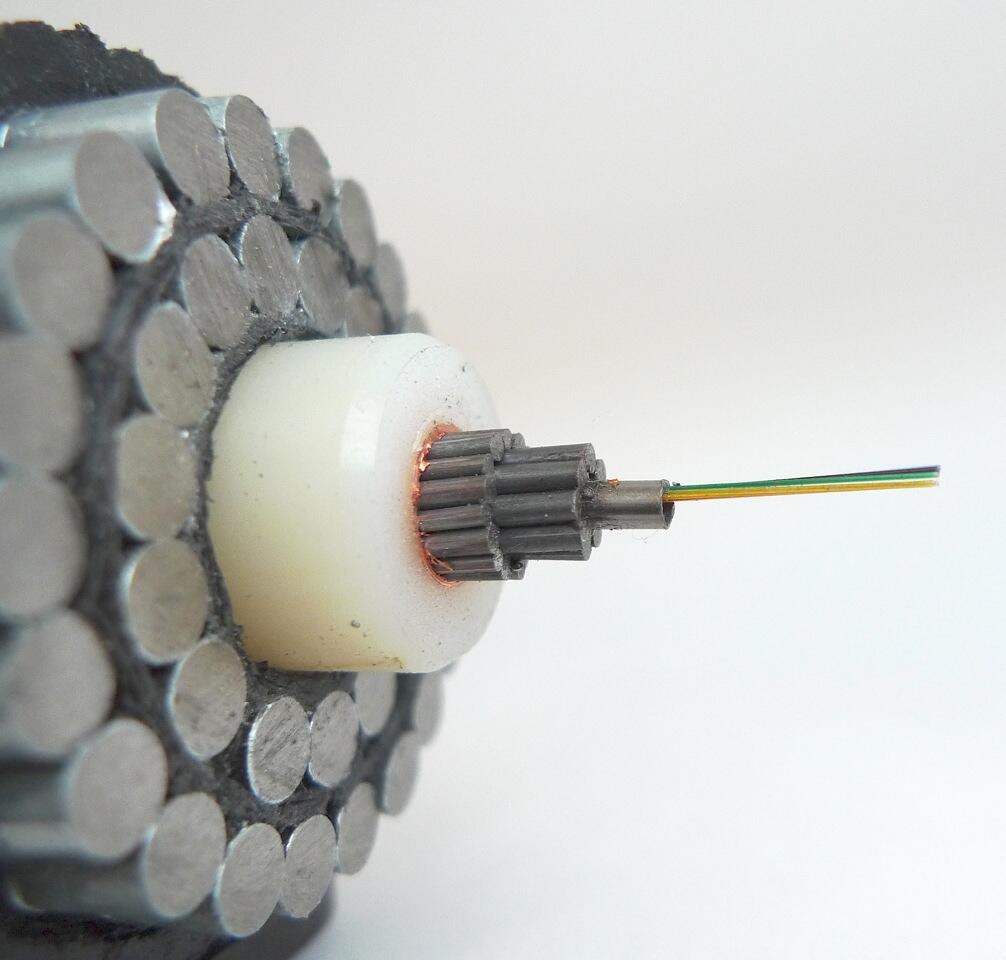

Maintenant que nous connaissons la distribution des centres de données dans le monde et leurs interconnexions locales grâce aux IXP, nous devons nous poser la question des envois de données intercontinentaux et à longue distance. Comment une donnée stockée sur un serveur dans un centre de données au Nevada arrive t-elle sur un terminal en France ? Comment cette donnée traverse t-elle l’océan en moins d’une seconde ? Elle partira du centre de données, passera par un point d’atterrissage de câble (cable landing point), c’est-à-dire un lieu sur la côte où un câble sous-marin fait surface. Elle traversera ce câble, arrivera au point d’atterrissage de l’autre côté de l’Atlantique, passera sûrement par un IXP et sera reçu sur le terminal. Un câble de 7000 kilomètres (distance moyenne entre un point d’atterrissage côte est U.S. et un point d’atterrissage français) permet l’intercommunication entre deux continents. Quelques questions se posent d’emblée pour bien comprendre cette partie de l’infrastructure : de quoi sont faits ces câbles et comment sont-ils installés ? Finalement, qui paye et qui en détient la propriété ?

Il y avait 406 câbles sous-marins dans le monde au début de l’année 2020, pour une longueur cumulée de 1,2 million de kilomètres. Ils permettent un débit plus ou moins important en fonction de leur âge de déploiement. Par exemple le FLAG Atlantic-1 (2000) qui relie Island Park, NY, à Plerin en Bretagne a un débit de 2x2.4 Tbps (Terabytes par seconde). Le nouveau câble MAREA (2018) a une capacité de débit de 208 Tbps, soit 43 fois plus de débit. À l’intérieur de ces câbles de 10 centimètres de diamètre, se trouvent plusieurs fibres optiques enrobées de caoutchouc, parfois de kevlar. Ils sont déposés au fond de l’océan par des navires spécialement conçus pour cette mission appelés “câbliers”. Ces navires permettent le déploiement mais aussi la réparation des câbles pour les télécommunications et le réseau énergétique. Les câbles ont une durée de vie minimum de 25 ans et peuvent rester opérationnel plus longtemps. Toutefois ils sont souvent remplacés plus tôt par des câbles plus récents avec une meilleure capacité de débit qui sont plus intéressant en termes économiques.

Pour que des données traversent des milliers de kilomètres via une fibre optique le signal est répété par un laser dans un point d’atterrissage. Ces point d’atterrissage sont généralement des bâtiments assez simples sur la côte avec quelques bureaux et les équipements réseaux nécessaires à la gestion du trafic. Par exemple, le signal lumineux envoyé par le laser d’un point d’atterrissage en France est reçu de l’autre côté de l’Atlantique par son vis-vis étatsuniens. Celui-ci le distribue ensuite sur le réseau internet nord-américain jusqu’à destination. Cette opération dure moins d’une seconde.

Les pannes sont généralement provoquées soit par un navire qui pose l’ancre sur le câble soit par de la pêche en eaux profondes si le filet embarque le câble. On dénombre en moyenne 100 accidents par an. Certains pays disposent de plusieurs câbles pour assurer leur connectivité intercontinentale, toutefois d’autres pays ne sont reliés à Internet que par un seul câble. Un dégât sur ce câble implique alors une coupure nationale de l’accès à Internet. En 2017, le câble reliant Madagascar à l’Afrique du Sud a été sectionné suite un séisme, provoquant une coupure au réseau Internet pendant 12 jours. En 2015, une section de câble a privé l’Algérie d’Internet pendant deux semaines.

Le déploiement d’un câble nécessite un capital financier énorme, aux alentours d’un milliard de dollars pour un câble transatlantique. Généralement des consortiums se forment pour co-investir et partager la propriété d’un câble. Ces dernières années, de nouveaux acteurs sont arrivés dans ce secteur, les GAFAM ont largement investis dans les nouveaux projets de câbles pour répondre à leur gigantesque besoin de trafic et pour prioriser le déploiement de routes dont ils ont besoin par rapport à leur stratégie.

Les antennes

L’infrastructure numérique compte sur de nombreuses antennes pour parcourir le premier ou le dernier kilomètre quand la fibre ne le peut pas, notamment dans le cas du trafic mobile via les smartphones. En effet, lorsqu’un smartphone se connecte à internet son premier point de contact est une antenne 2G/3G/4G/5G. Une antenne est un équipement réseau qui diffuse un signal à une certaine fréquence, comme une tour radio. Un smartphone se synchronise à cette fréquence pour envoyer des données et à une autre pour recevoir des données. Une antenne est généralement fixée à un support, c’est-à-dire, une tour qui sert d’arrimage à plusieurs antennes et qui est raccordé au réseau électrique et au réseau fibre. Chaque antenne, ou le support d’antenne, est reliée à une fibre optique qui part ensuite en souterrain ou en aérien (attachée à des poteaux dans la rue). Cette fibre part ensuite jusqu’à un centre de données capable de traiter la demande ou via un IXP. Il faut donc retenir qu’une antenne est généralement égale à un raccordement à la fibre, il n’y a donc que la connexion entre le smartphone et l’antenne qui est sans-fil.

On distingue 3 types d’équipements sans-fil : le support, la station et l’antenne. Le support est l’élément physique qui sert d’attache aux stations et donc aux antennes. Une station indique la présence des équipements d’un opérateur sur un support. Une antenne fait partie de la station déployée par un opérateur. En fonction du nombre d’opérateurs, un support peut servir à plusieurs stations. Chaque support est raccordé au réseau filaire et au réseau électrique. Les stations vont utiliser de l’électricité pour diffuser un signal en continu, traiter des requêtes et recevoir/envoyer des données via leurs antennes. De la puissance électrique est aussi utilisé pour la climatisation de l’installation car les stations sont situées sur des toits ou des points élevés non ombragés et produisent de la chaleur. Côté usager, un smartphone consomme plus d’électricité lorsqu’il fonctionne en réseau cellulaire (3G/4G) plutôt qu’en WiFi. En effet, la distance à parcourir est généralement moins longue via la WiFi car il s’agit d’atteindre la box la plus proche dans un foyer ou un lieu professionnel.

En 2020, on compte 46 685 supports, 85 532 stations et 223 480 antennes en France, tous opérateurs et fréquences confondus. Chaque territoire n’est pas couvert de la même façon. Les zones urbaines sont logiquement plus couvertes car elles concentrent plus de trafic. On y trouve plus de stations et d’antennes par habitant et au km2 car la densité de population est plus élevée et aussi les usages numériques urbains sont plus intenses en données, comme le visionnage de vidéos dans les transports en commun. On compte à Paris (75) 17 supports, 23 stations et 61 antennes par km2 (superficie totale de 105km2), ainsi que 0,8 support, 1 station, et 2,8 antennes pour mille habitants (2 273 305 habitants en 2013). Les zones urbaines denses impliquent donc une densité de supports au km2 mais cela n’implique pas forcément un déploiement dense par rapport au nombre d’habitants. À titre de comparaison, la Lozère (48) accueille 0,03 support, 0,07 station et 0,16 antenne par km2 (superficie de 5 176km2). Rapporté à la population, il y a 1,8 support, 4,9 stations et 10,7 antennes pour mille habitants (77 085 habitants en 2013).

| Paris (75) | Lozère (48) | |

|---|---|---|

| Support/km² | 17,238 | 0,028 |

| Station/km² | 23,267 | 0,074 |

| Antenne/km² | 61,448 | 0,074 |

| Support/mille hab. | 0,796 | 1,881 |

| Station/mille hab. | 1,075 | 4,930 |

| Antenne/mille hab. | – | 10,754 |

| Notes | 105 km² 2 273 205 hab. (2013) | 5 167 km² 77 085 hab. (2013) |

La couverture effective d’un territoire pour le trafic mobile (support/station/antenne) doit toujours être comprise par rapport à la superficie totale à couvrir et à la densité de population. Ce n’est pas parce qu’il y a plus de support par habitant en Lozère qu’il y a plus de support au km2. Cela est due au fait que la population en Lozère est en moins importante et beaucoup plus dispersée qu’à Paris.

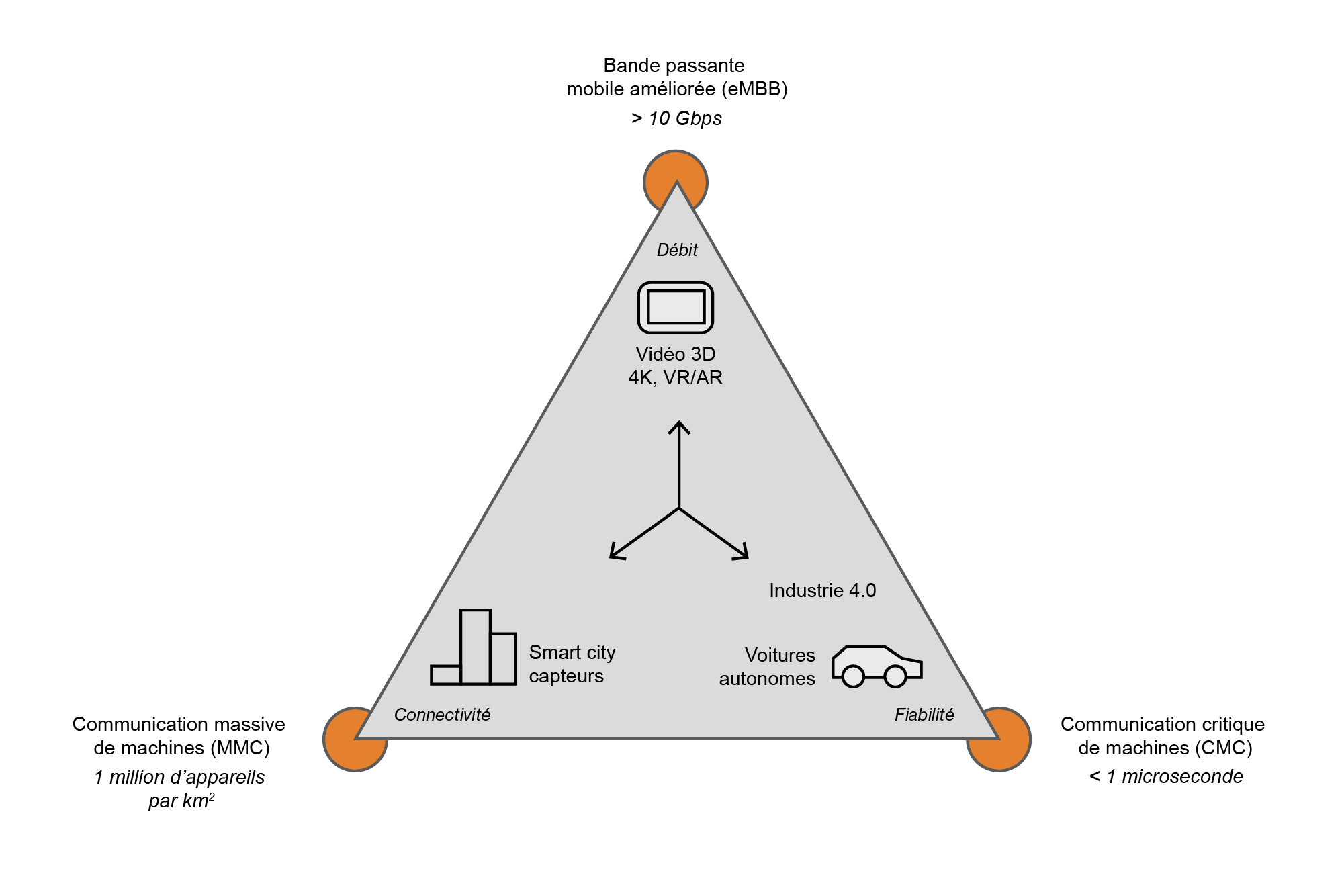

En dernier lieu, la portée maximum d’une antenne varie en fonction du débit de celle-ci. Plus une antenne a de la portée moins elle permet de transporter d’information. Par exemple les antennes 5G dernière génération permettent un débit de 1Gb/s mais n’ont une portée que de 150 mètres en moyenne. Ces antennes peuvent avoir leur place dans un milieu urbain très dense mais ne sont pas pertinentes dans un territoire où la population est très dispersée. De façon générale, la dernière génération de réseau mobile (5G) propose des applications professionnels et grand public mais pose aussi de nombreuses questions sur sa viabilité énergétique, environnementale et économique. Un rapport du même auteur que ce document, intitulé “La controverse de la 5G” traite du sujet.

Pour résumer, dans l’infrastructure numérique les réseaux mobiles servent généralement à parcourir le dernier kilomètre séparant un appareil mobile du réseau général. Le trafic “capturé” par les antennes/stations part ensuite dans le réseau fibré, comme le trafic fixe, pour atteindre le coeur de l’infrastructure, c’est-à-dire le centre de données.

Les équipements utilisateurs

Notre vie quotidienne se compose aujourd’hui de nombreux appareils connectés : smartphones, ordinateurs, box internet, télévisions, montres connectées, consoles de jeu vidéo, enceintes connectées, voitures, thermostat connecté; frigo connecté, etc. Le fonctionnement de chaque de ces appareils implique le transfert de données sollicitant des centres de données et le réseau, en utilisation comme en veille. Il y a aussi tous les objets et capteurs connectés utilisés dans le milieu professionnel, on peut penser aux caméras de surveillance, aux capteurs industriels, aux feux de signalisation, aux navettes autonomes, à certains types de tracteurs, etc. La caractéristique principale de ces équipements est leur volume. En 2019, l’écosystème numérique compterait 37 milliards d’équipements informatiques, dont 3,5 milliards de smartphones, 3,8 milliards d’autres téléphones, 3,1 milliards de télévisions/écrans/vidéoprojecteurs et à peu près 19 milliards d’objets connectés. Le reste de ces équipements est regroupé autour des réseaux (antennes, box) et des centres informatiques. Une telle masse d’équipements témoigne donc de l’arrivée massive des objets et capteurs connectés dont on estime qu’ils pourraient représenter à eux seuls un volume de 50 milliards d’ici 2025. Hors objets connectés, la progression des autres équipements stagne car les marchés sont saturés dans les pays fortement intégrés à l’infrastructure numérique. De nombreuses entreprises misent sur les pays “émergents” pour écouler leurs stocks d’appareils.

Dans cette galaxie d’appareils le smartphone est sûrement l’emblème de l’infrastructure numérique contemporaine. Il est devenu un appareil incontournable pour de nombreuses personnes quelque soit le pays. On l’utilise pour consulter son compte en banque, payer, gérer ses emails, regarder des films, lire les nouvelles, pour payer les transports en commun et bien d’autres usages. En 2020, il y aurait entre 4 et 4,5 milliards d’utilisateurs d’internet dans le monde dont 91% utiliseraient un smartphone, soit entre 3,6 et 4 milliards d’utilisateurs actifs de smartphones. Les livraisons mondiales de smartphones étaient de 1,389 milliards d’unités en 2018 et 1,366 milliards en 2019. Depuis 2015, les ventes annuelles se sont stabilisées aux alentours de 1,5 milliards de smartphones : le marché des smartphones est aujourd’hui en saturation.

| Vendeur | Livraisons 2018 | Livraisons 2019 |

|---|---|---|

| Samsung | 293,3 | 298,1 |

| Huawei | 206 | 240,6 |

| Apple | 212,2 | 198,1 |

| Xiaomi | 120,6 | 125,5 |

| Oppo | 116 | 120,2 |

| Autres | 441,4 | 384,3 |

| Total | 1389,4 | 1366,7 |

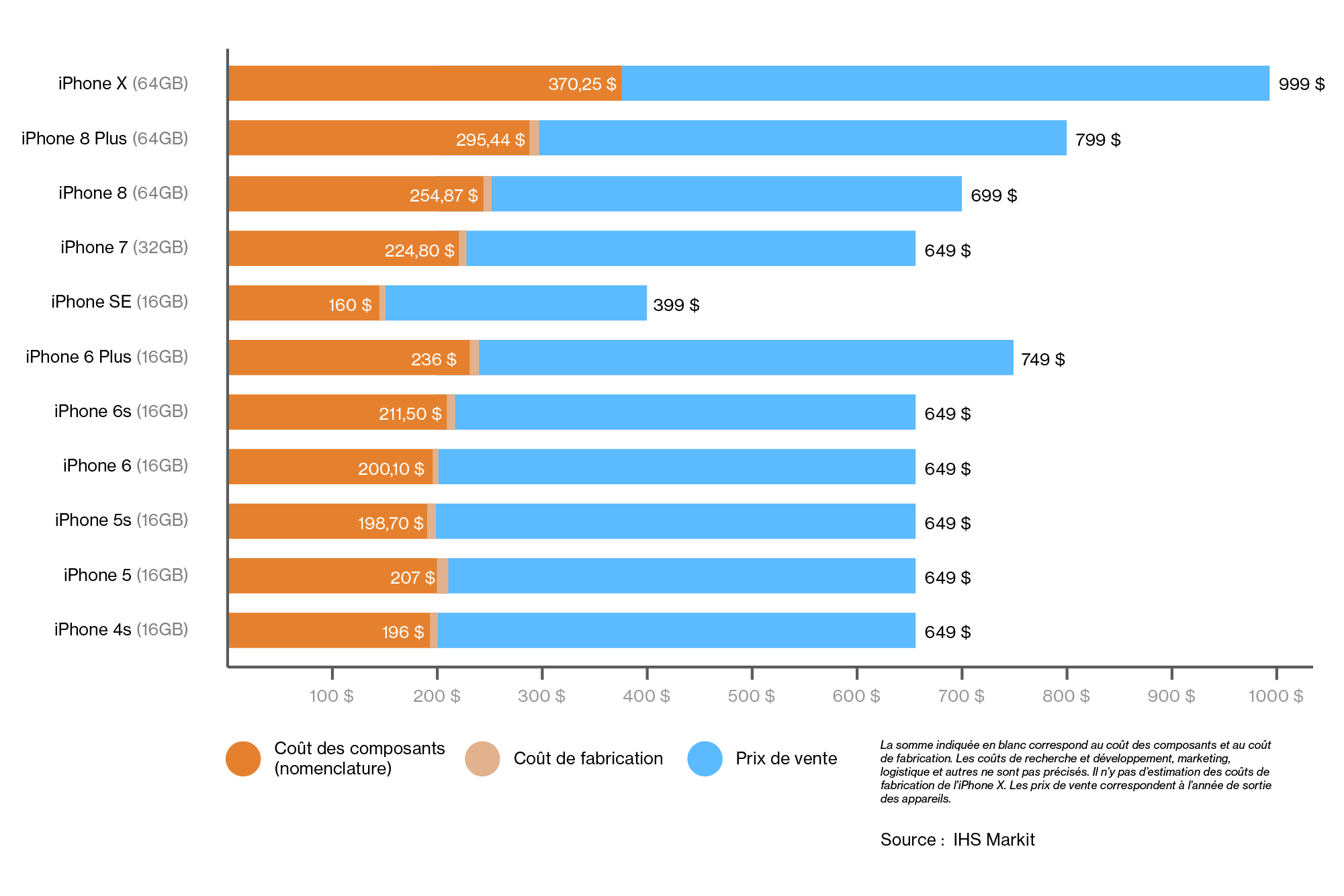

Sait-on combien coûte la production d’un équipement numérique comme un smartphone ? De plus, sait-on combien de ressources (eau, énergie, minerais, etc.) sont nécessaires à la production d’une telle masse d’équipements ? Pour déterminer les coûts des composants d’un appareil on utilise une “nomenclature” ou Bill of Materials (BoM) en anglais. Cette nomenclature permet de déterminer le prix de chaque composant et le poids de chaque composant dans la facture de production totale. Par exemple, le coût de l’écran d’un iPhone 7 représentait 17,7% du coût total des composants. Pour un iPhone X, l’écran représentait 29,7% du coût total des composants. Avec chaque nouvelle génération de smartphones la taille des écrans augmente et le coût de l’écran représente une part de plus en plus importante de la nomenclature.

| Estimation BoM | iPhone X | iPhone 7 | ||

|---|---|---|---|---|

| Coût ($) | % (BoM) | Coût ($) | % (BoM) | |

| Écran tactile | 110 | 29,7 | 39 | 17,7 |

| Éléments électromécaniques | 61 | 16,5 | 34,9 | 15,8 |

| Caméra | 35 | 9,5 | 19 | 8,6 |

| Processeur | 27,5 | 7,4 | 26,9 | 12,2 |

| Système RF | 18 | 4,9 | 33,9 | 15,4 |

| CI Alimentation | 14,25 | 3,8 | 7,2 | 3,3 |

| Mémoire | 33,45 | 9 | 16,4 | 7,4 |

| RF/Amplificateur | 16,6 | 4,5 | 7,2 | 3,3 |

| CI Interface | 12,4 | 3,3 | 14 | 6,3 |

| Capteur “TrueDepth” | 16,7 | 4,5 | 0 | 0 |

| WLAN / Bluetooth | 7,35 | 2 | 8 | 3,6 |

| Batteries | 6 | 1,6 | 2,5 | 1,1 |

| Contenu boîte | 12 | 3,2 | 11,8 | 5,3 |

| Total | 370,25 | 100 | 220,8 | 100 |

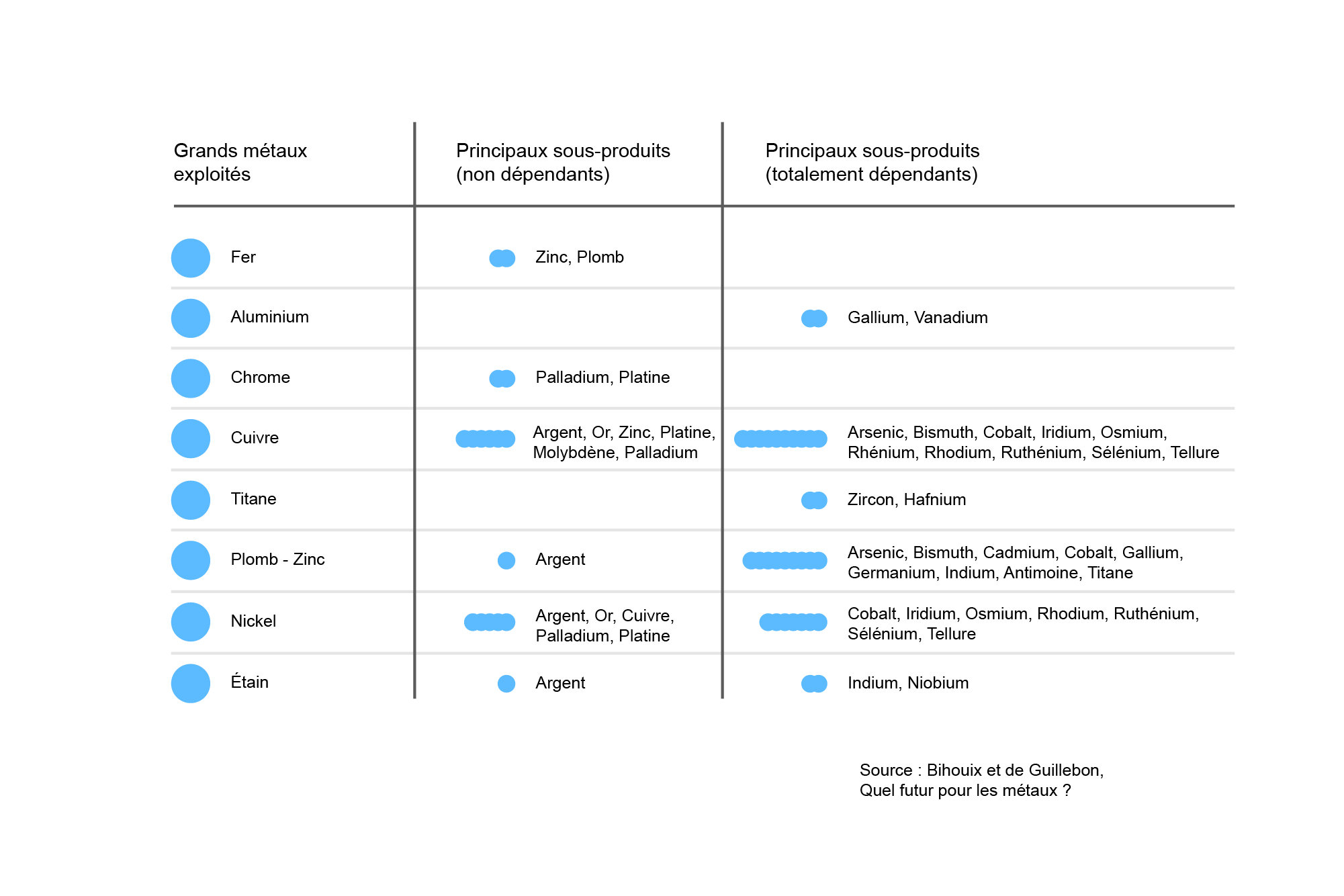

Pour produire des composants il faut de la matière transformée (métaux, plastique, etc.). Quelle part représente ces matières dans le prix total d’un smartphone ? Une étude anglaise publiée en 2015 estimait que pour un téléphone de £600 l’achat des matières brutes correspond à £1,5, soit 0,25% du prix de vente. Cela représente théoriquement la part de l’exploitation minière puisque c’est elle qui vend la matière brute. Ce chiffre peut varier en fonction des modèles et des composants. La course à la miniaturisation crée une demande sur des métaux plus rares ou plus compliqués à extraire, ce qui augmente leur prix. On estime qu’un smartphone intègre entre 45 et 50 métaux différents, dans des proportions très différentes, en plus des autres matériaux usuels (plastiques, caoutchouc, etc.). L’entreprise de smartphones “Fairphone” a mis à disposition une carte interactive qui permet de voir l’ensemble de ses fournisseurs, des minerais aux plastiques. L’entreprise compte à peu plus de 110 fournisseurs répartis sur plus de 30 pays. Pour comparer à un autre fabricant, on estime que la fabrication d’un iPhone nécessite une chaîne d’approvisionnement impliquant 43 pays.

Parmi les nombreux minerais qui composent un smartphone, certains sont extraits dans des conditions très difficiles, à l’encontre des droits humains et environnementaux. Des exploitations minières sont parfois contrôlés par des seigneurs de guerre ou des cartels locaux qui emploient hommes, femmes et enfants. Au même titre que l’on parle des “diamants de sang” on parle de “minerais de conflits” (conflict minerals). Fairphone a essayé de choisir des fournisseurs qui ne sont pas impliqués dans ce genre de pratiques sur 10 métaux critiques parmi les 38 qui composent leur smartphone : cobalt, cuivre, gallium, or, indium, nickel, terres rares, tantale, étain et tungsten. Toutefois, de l’aveu de l’ancien PDG de l’entreprise il n’est pas possible de faire un smartphone “juste” (fair) mais seulement un smartphone un peu plus juste (fairer) car les chaînes d’approvisionnement de beaucoup de fournisseurs sont opaques et il est parfois impossible de connaître la provenance de certains matériaux et les conditions d’extraction.

La vie d’un équipement utilisateur ne s’arrête pas à la production et à l’usage, il y a aussi la fin de vie. Que se passe t-il lorsqu’on amène sa télévision à la décharge ou lorsqu’on jette son smartphone ? En 2016, On estime que 44,7 millions de tonnes métriques de déchets d’équipements électriques et électroniques (DEEE) ont été générées. Cela représente en une année une masse équivalente à 4 500 tours Eiffel ou 6,1 kilos par habitant. Cette masse d’équipements en fin de vie continue à augmenter à cause du renouvellement trop rapide des équipements. Dans le cas du smartphone, on a estimé sa durée de vie à 21,6 mois en 2015, soit moins de 2 ans. Cela est lié aux campagnes marketing qui encourage ce renouvellement, mais aussi lié aux différents types d’obsolescence (logicielle, matérielle, psychologique) et de la masse de livraisons annuelles à écouler. Les métaux et les composants de ces équipements sont peu, voire très peu recyclés sauf pour certains cas comme le cuivre sans que ce recyclage implique la fin de l’extraction minière du cuivre. Beaucoup de cuivre est immobilisé dans le bâti et les infrastructures et ne repart dans les circuits de production.

Ce qui caractérise fondamentalement les équipements numériques, personnels comme professionnels, c’est leur masse. Nous produisons des milliards d’équipements chaque année stimulant des chaînes d’approvisionnement très complexes et parfois opaques, notamment dans le cas de l’extraction minière. Le renouvellement forcé des équipements pose des problèmes considérables de gestions des déchets ou de réutilisation des équipements considérés comme “obsolètes”. À ce titre les équipements utilisateurs sont à la fois le début et la fin des infrastructures numériques, de la mine à la décharge, avec seulement quelques années d’usage entre temps. Ces flux et ces systèmes posent de nombreux questions que nous étudierons dans la partie sur les impacts environnementaux.

Les tendances de développement du numérique

Les infrastructures et les usages du numérique continuent à évoluer et sont sujets à de nombreuses interprétations sur leur développement futur. Ces exercices de projection servent notamment à tirer des courbes et des tendances pour rendre les futurs plus certains et adapter dès aujourd’hui les modèles de développement. Toutefois, le numérique n’est pas une infrastructure isolée et elle est elle-même influencée par d’autres systèmes, d’autres infrastructures, d’autres idées : l’extraction de ressources, la production d’énergie, l’idée de croissance économique et de progrès technologique, etc. Il est alors important de comprendre comment les sociétés numérisées de 2020 définissent le développement du numérique dans les années et les décennies à venir : quels usages, quels secteurs, quels facteurs, quels imaginaires favorisent-elles pour produire les futurs souhaités par les grands acteurs du numérique ?

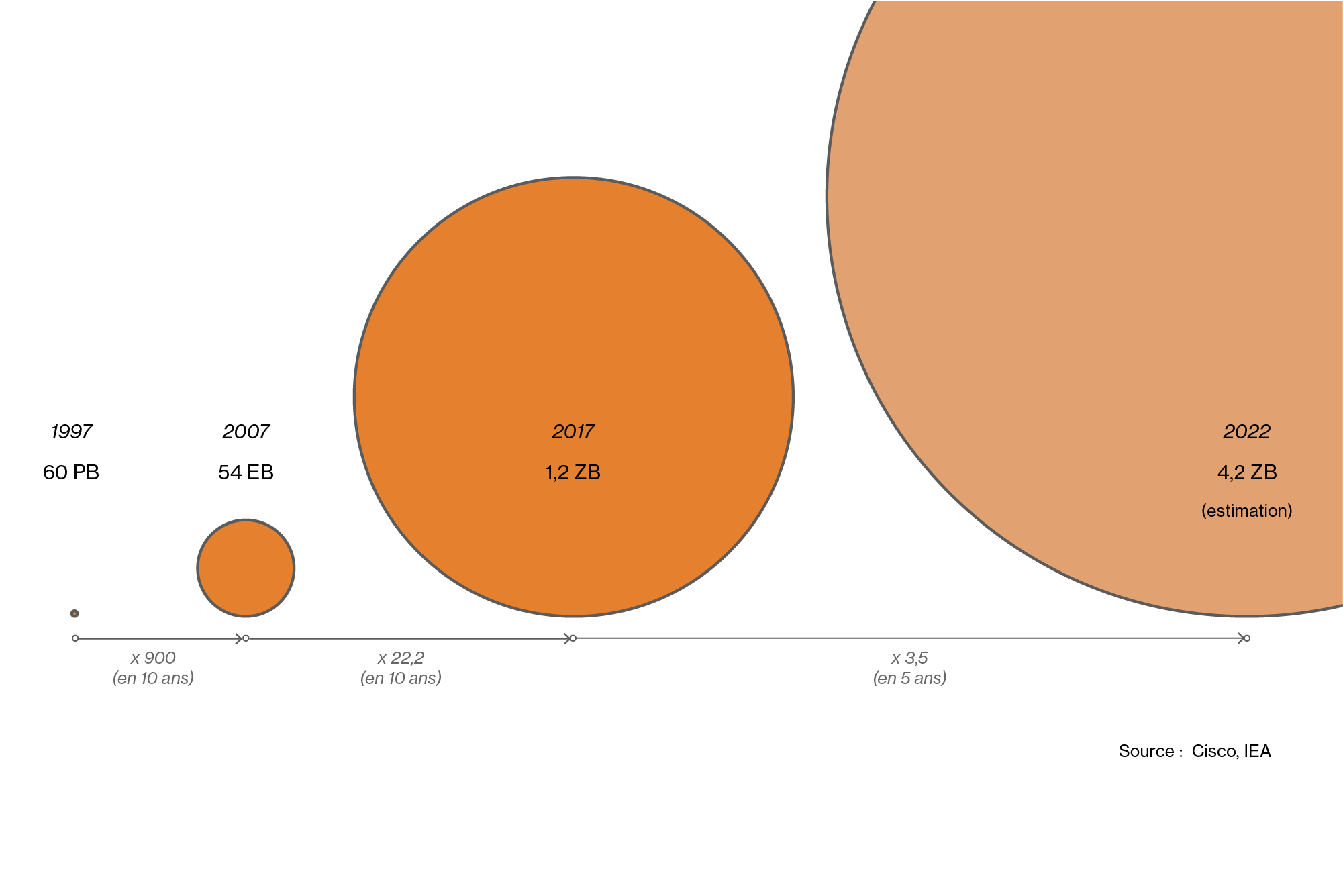

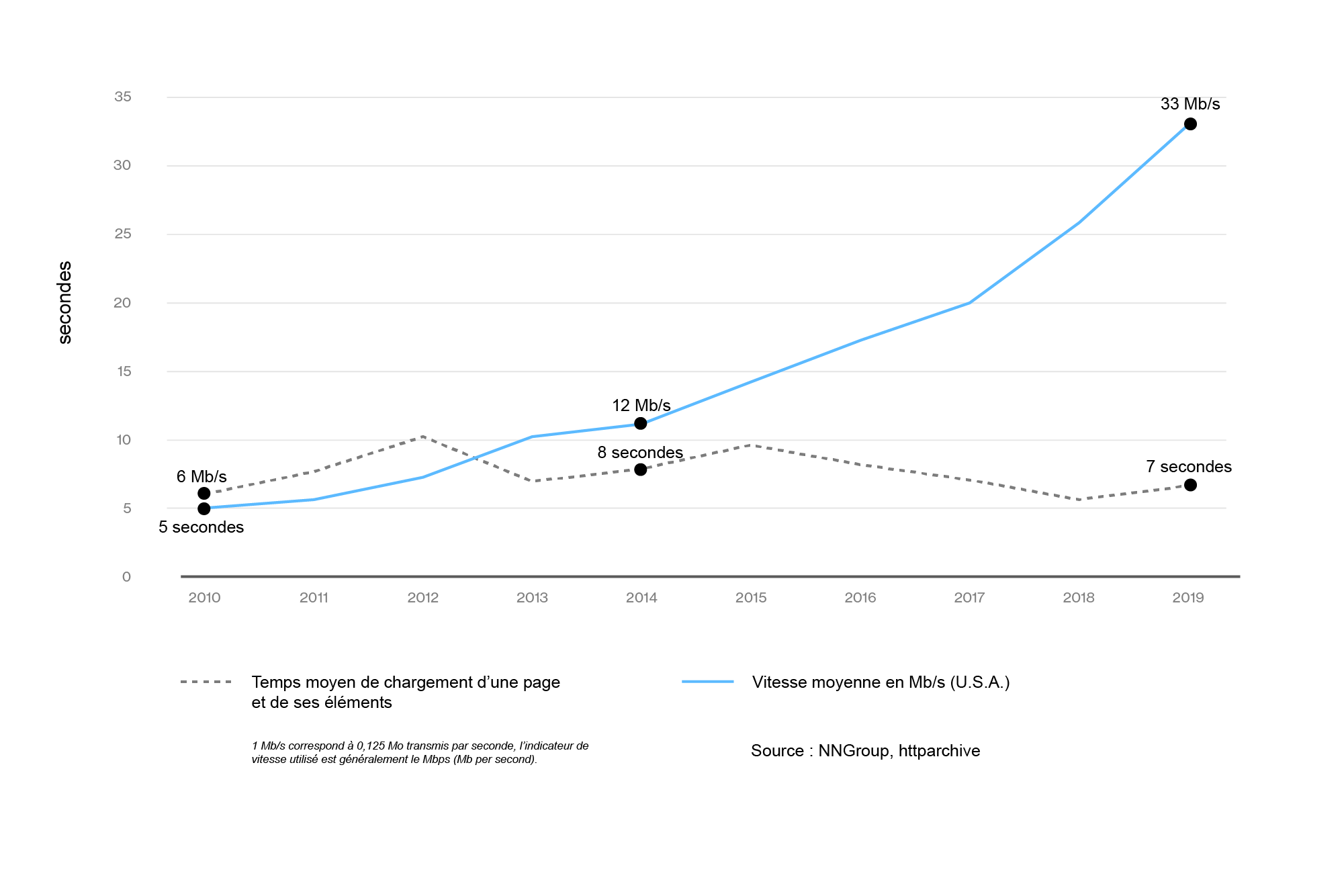

Le trafic

Une des premières données que l’on projette dans le futur est sûrement le trafic. Aujourd’hui, on ne voit qu’une seule évolution possible : son augmentation. Cisco rapporte que le trafic internet global en 2017 était de 1,2 ZT (Zettabyte). Pour ramener ce chiffre a une valeur plus connue comme le GB (Gigabyte), 1,2 ZB est égal à 1 117 587 089 538 GB, soit 1 117 milliards de GB. Cela implique qu’à peu près 127 000 000 GB circulent en moyenne chaque heure. Cisco estime qu’en 2022 le trafic global atteindra 4,2 ZB, soit une multiplication par 3,5 en 5 ans. Ces estimations sont à peu près partagées par tous les acteurs de l’infrastructure numérique. Cette augmentation s’explique avec 4 facteurs : une plus grande part de la population mondiale utiliserait internet dans une avenir proche, 4,8 milliards en 2022 contre 3,5 milliards en 2017; l’augmentation du taux d’équipement numérique par habitant, 2,4 équipements par personne en 2017 contre 3,6 en 2022; l’augmentation de la vitesse de transfert et finalement l’augmentation de l’usage vidéo, 75% du trafic en 2017 contre 82% en 2022.

Ces facteurs n’offrent cependant qu’une vue partielle pour comprendre l’évolution du trafic, car une question importante se pose : au-delà de l’augmentation, est-il possible de “piloter” l’évolution du trafic ? Cette question est importante car une grande partie des hypothèses de développement du numérique se base sur une augmentation constante sans jamais soulever l’hypothèse d’un pilotage en vue d’une stabilisation ou même d’une baisse.

Par exemple, la nature des forfaits mobiles, auxquels nous souscrivons tous, influe sur notre consommation de données. Un forfait illimité favorise une consommation croissante de données. De même, un réseau télécom qui offre une très bonne qualité de signal, un bon débit et une bonne couverture est nécessaire à la consommation de services plus lourds en données, comme une vidéo par exemple. Recevoir un signal de bonne qualité, calculer des opérations complexes, lire une vidéo en très haute définition, travailler sur des fichiers de façon synchronisée avec d’autres personnes nécessitent des appareils puissants, cela vaut pour les ordinateurs comme pour les smartphones. Obtenir un bon signal implique aussi des composants de qualité (antenne, etc.). De plus, les caractéristiques des équipements influent aussi sur le trafic : a priori je ne peux pas me connecter au réseau 4G si mon smartphone ne dispose pas d’un émetteur/récepteur compatible 4G. Finalement la nature des services numériques proposés sur le réseau est sûrement le principal facteur d’évolution du trafic. Une grande partie des services numériques populaires aujourd’hui sont souvent “intensifs” en données, c’est-à-dire, qu’ils font transiter une masse relativement importante de données par minute d’utilisation. Cette intensité peut être liée aux types de média distribués, les vidéos sont les formats grand public les plus lourds en données, et aussi aux méthodes de captation des données et de l’attention.

Dans le trafic internet mondial le trafic mobile représente une part de plus en plus significative. Le gestionnaire et équipementier de réseau Cisco estime que le trafic mobile atteindra 77 EB par mois en 2022, soit une multiplication par 7 de ce trafic depuis 2017 (12 EB par mois). En suivant cette projection le trafic mobile s’élèverait donc à 924 EB par an en 2020. Ce chiffre représente presque l’ensemble du trafic fixe et mobile en 2017 et à peu près un quart du trafic global estimé en 2022 par Cisco. Aujourd’hui la hausse du trafic mobile est largement souhaitée par les acteurs du numérique afin d’avoir accès à de nouveaux publics et donc à de nouveaux marchés, notamment dans les pays du Sud.

Aujourd’hui les différents grands acteurs du numérique présentent un avenir de l’infrastructure avec toujours plus de trafic. L’intensité en données des services numériques pèsent aujourd’hui de tout son poids pour influencer le trafic à la hausse. Tous les autres acteurs semblent aujourd’hui s’adapter à cette situation bien que la relation soit asymétrique. Pourtant les quatre indicateurs d’évolution du trafic montre qu’il y a bien des leviers de contrôle.

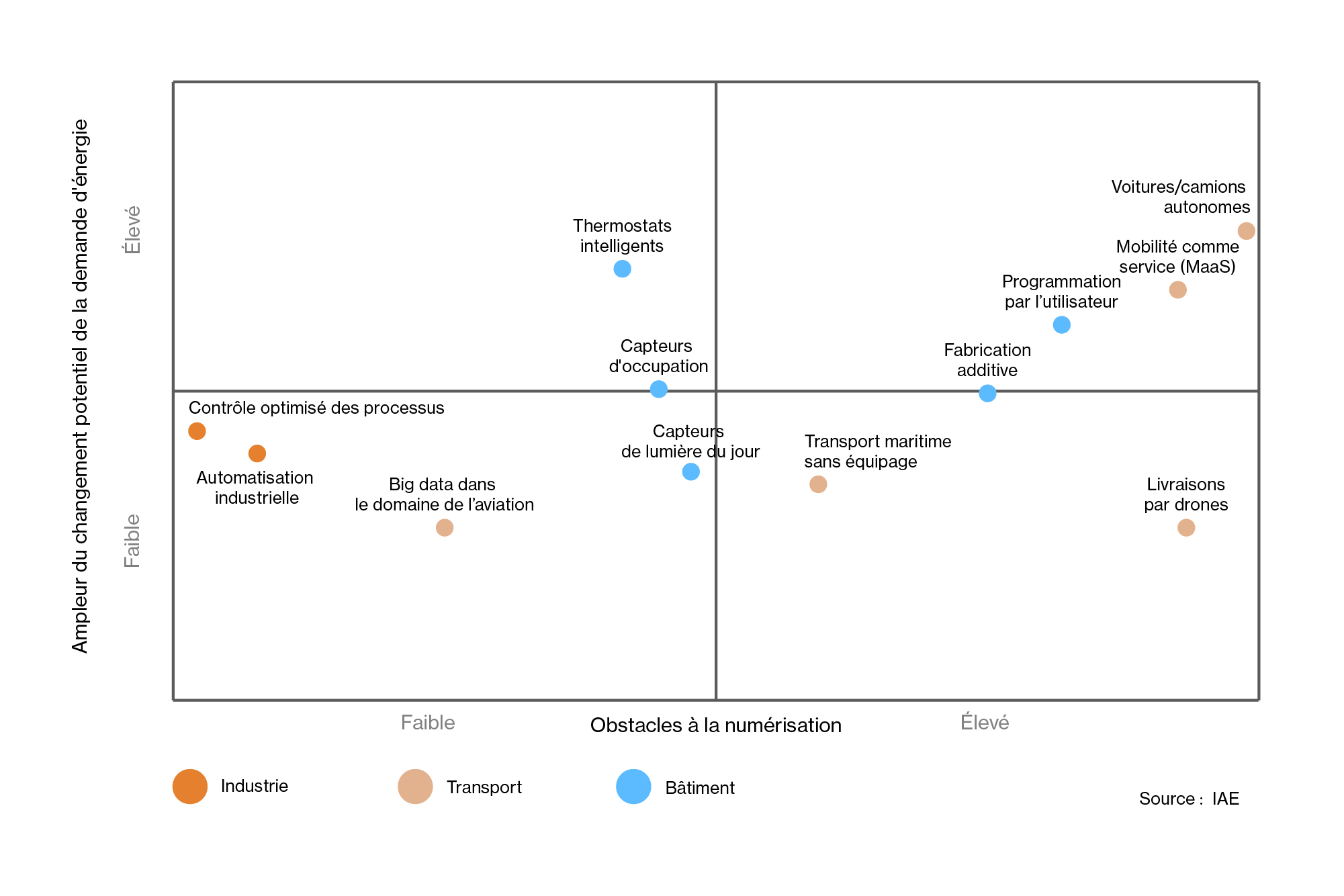

La recherche de débouchés

De nombreux acteurs s’efforcent de promouvoir la numérisation de pans entiers de l’économie. Certains espoirs sont notamment portés vers le secteur industriel, le secteur des transports et du bâtiment. Les scénarios de numérisation croissante de ces secteurs se traduisent généralement par l’installation massive de capteurs permettant la captation et l’analyse de données. On suppose alors que l’accumulation de données et leur traitement permettraient l’optimisation ou l’automatisation de processus industriels, de régulation de consommation divers (comme l’électricité) et l’usage de programmes apprenants (comme la conduite de véhicules par exemple). L’Agence Internationale de l’Énergie (IAE) a produit en 2019 un tableau pour essayer d’estimer la faisabilité et les impacts potentiels de la numérisation de ces secteurs, notamment par rapport à la demande énergétique globale. L’IAE a estimé que l’automatisation industrielle, l’optimisation des processus industriels ou l’usage de masse de données dans l’aviation étaient à la fois plausible sans que cela affecte considérablement la demande énergétique, toutefois les véhicules autonomes représentent un avenir peu plausible et un impact très fort sur la demande énergétique (à la hausse).

Le secteur de l’énergie, particulièrement celui des énergies fossiles, semble aussi être un milieu attirant pour le secteur numérique. Amazon, Google, Microsoft sont connus pour avoir des branches dans le secteur de l’énergie, notamment pour gérer leur propre approvisionnement, mais aussi pour vendre des solutions “d’intelligence artificielle” et de traitement de masse des données aux compagnies pétrolières et gazières. Le marché global pour les solutions “d’intelligence artificielle” dans le secteur des énergies fossiles était estimé à 1,75 milliard de dollars en 2018 et pourrait atteindre 4,01 milliards de dollars en 2025, soit un taux de croissance annuelle de 12,5%. Dès 2017, les équipes commerciales de vente d’Amazon Web Services démarraient leur séminaire annuel intitulé “Positioning for Success in Oil & Gas” (se positionner avec succès dans le secteur du pétrole et du gaz) et Amazon Power vend ses services afin de trouver et de récupérer plus efficacement du pétrole ainsi que de réduire le coût par baril. Les grands acteurs du numérique estiment aussi qu’ils peuvent aider à faciliter l’usage d’énergies renouvelables et d’optimiser leur production. Toutefois ce double discours rappelle qu’il est toujours important de comprendre ces compagnies dans leur dimension globale en observant cas par cas leurs activités pour dépasser le simple effet de communication.

Finalement, une explosion des objets connectés est souhaitée par de nombreux acteurs du secteur numérique et industriel. Cette explosion est généralement associée à la question de la “smart city” qui désigne l’implémentation massive de capteurs pour gérer les flux d’une ville (trafic, énergie, voirie, déchets, eau, etc.) dans l’idée de les optimiser. Cette idée est aussi répétee dans le contexte de la “smart home” (maison intelligente). Dans une étude de 2017, certains analystes estimaient que 50 milliards d’objets connectés seraient actifs en 2030. Ce chiffre est à relativiser car Cisco prévoyait déjà dans une étude 2011 que 50 milliards d’objets connectés seraient déployés en 2020. Néanmoins, le marché global de l’Internet des Objets (IoT) était évalué à 193 milliards de dollars en 2019 et est estimé à 657 milliards d’ici 2025, soit une croissance annuelle de 21% pendant 5 ans. Il est généralement estimé que le marché des objets connectés pourrait représenter à terme la moitié du marché du secteur numérique. C’est donc un marché particulièrement disputé par de nombreux acteurs du numérique, entraînant une course à la numérisation de nombreux objets du quotidien (thermostat, montre, enceinte, frigo, etc.) et d’objets à vocation “industrielle” (compteur d’eau, compteur d’électricité, etc.).

Les pistes énoncées ici sont des scénarios proposés par différents acteurs qui ont des intérêts financiers à faire advenir ces propositions (industries, investisseurs, etc.). Ces scénarios servent notamment à créer des imaginaires pour interroger leur acceptation sociale et parfois pour créer du consentement. Ils n’évacuent toutefois pas la complexité derrière de tels déploiements : enjeux sociaux et démocratiques, impacts environnementaux, faisabilité technique, rentabilité financière. Il est important de se rappeler que les évolutions technologiques ne sont pas des révolutions où tout change d’un coup, ce sont des systèmes qui s’additionnent aux systèmes précédents et qui creusent un sillon petit à petit. Tous ces scénarios restent à éprouver pour considérer s’ils sont réalistes ou non, souhaitables ou non, notamment dans le cadre des transitions à opérer.

Les impacts environnementaux du numérique

Pour considérer quels scénarios de développement du numérique sont possibles il est nécessaire dans un premier temps d’estimer leur soutenabilité à plusieurs niveaux. Comme nous l’avons vu dans les cahiers précédents l’infrastructure numérique sollicite de nombreux écosystèmes pour extraire les matières premières nécessaires à la production de composants. Elle s’appuie aussi sur des chaînes d’approvisionnement et de production globales afin de livrer des produits numériques partout dans le monde. Elle nécessite de l’énergie (pas seulement de l’électricité) à tous les niveaux, produisant plus ou moins de gaz à effet de serre. Finalement cette infrastructure entraîne aussi une production de déchets très peu recyclables ou non recyclés en aval.

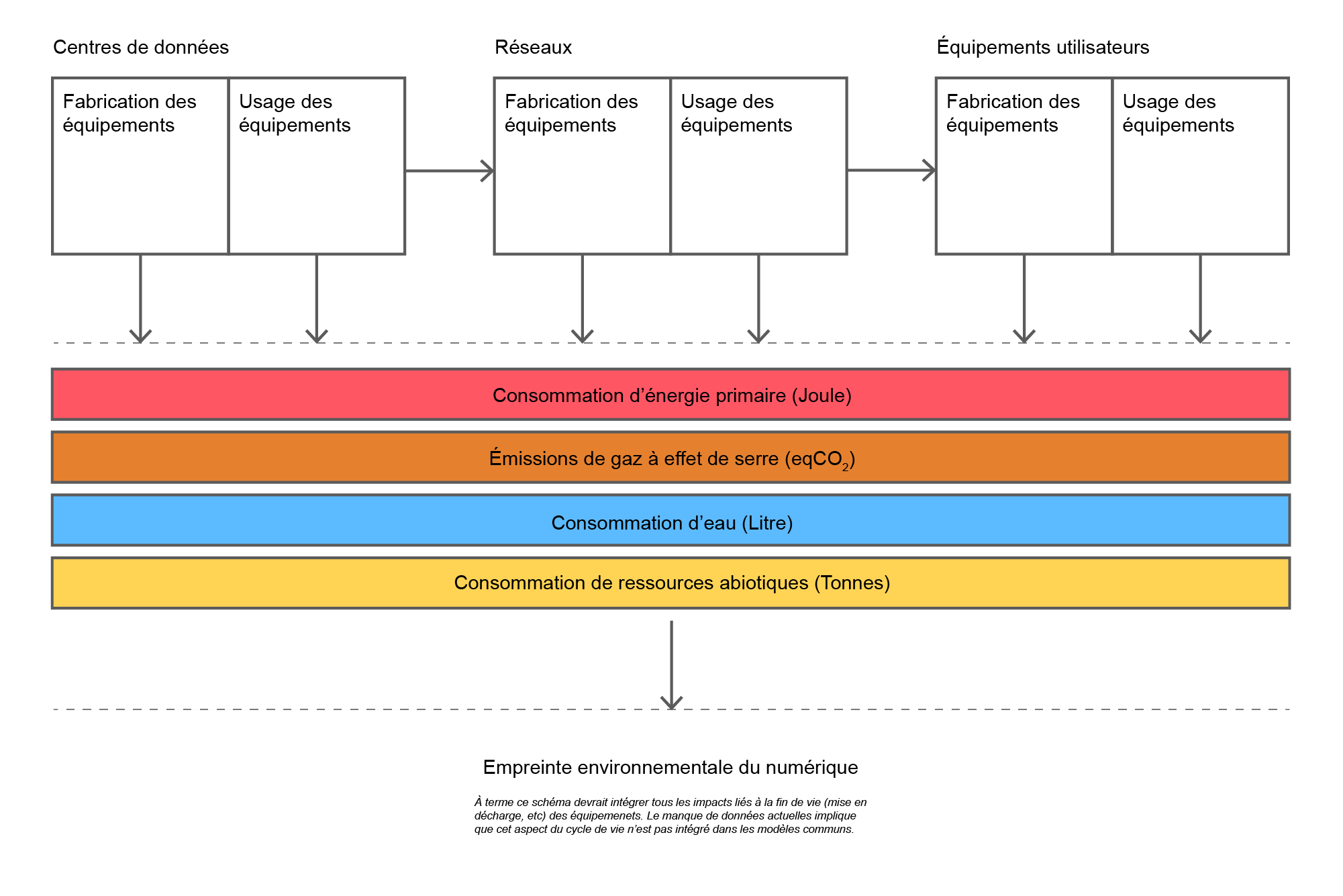

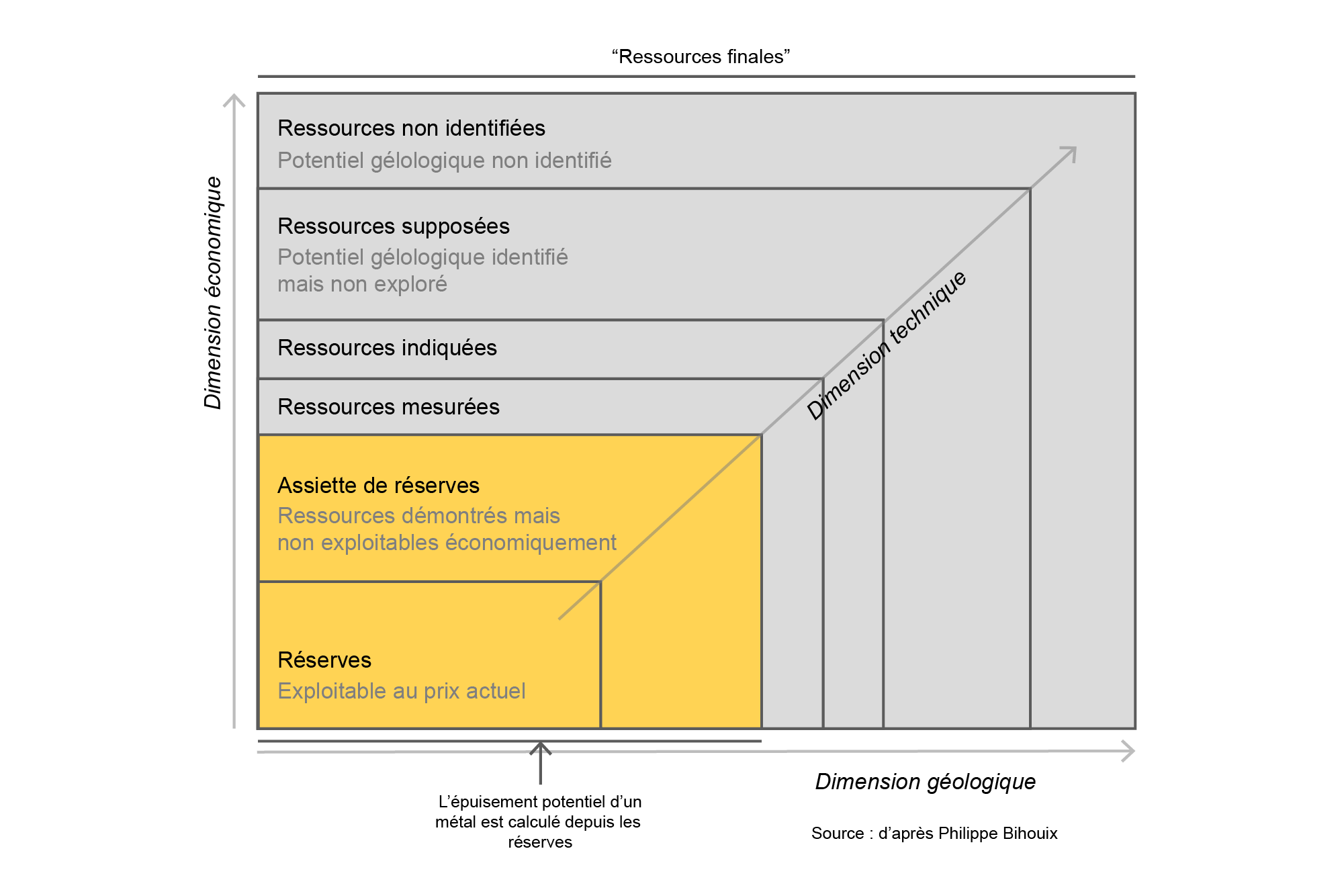

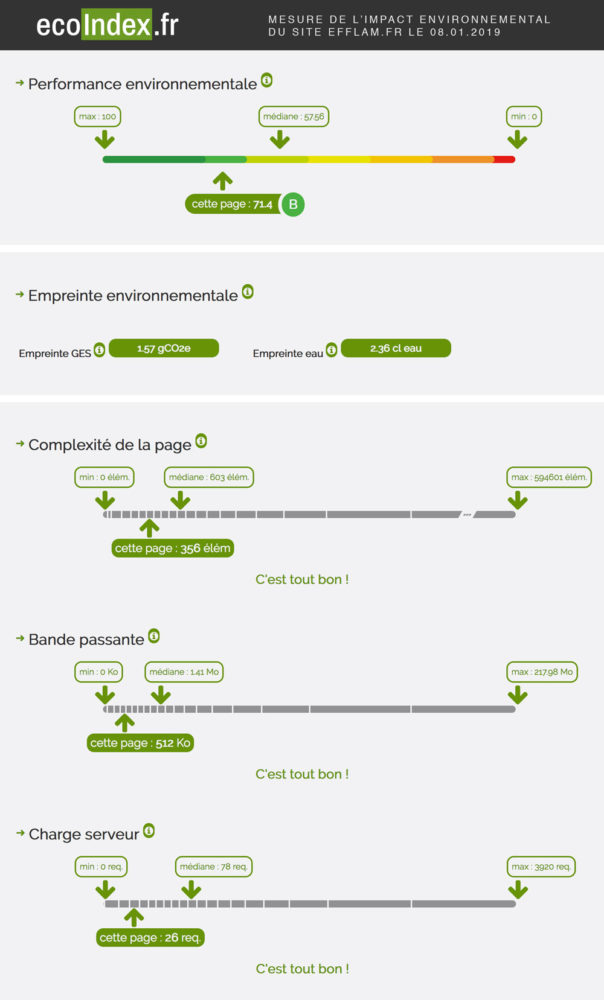

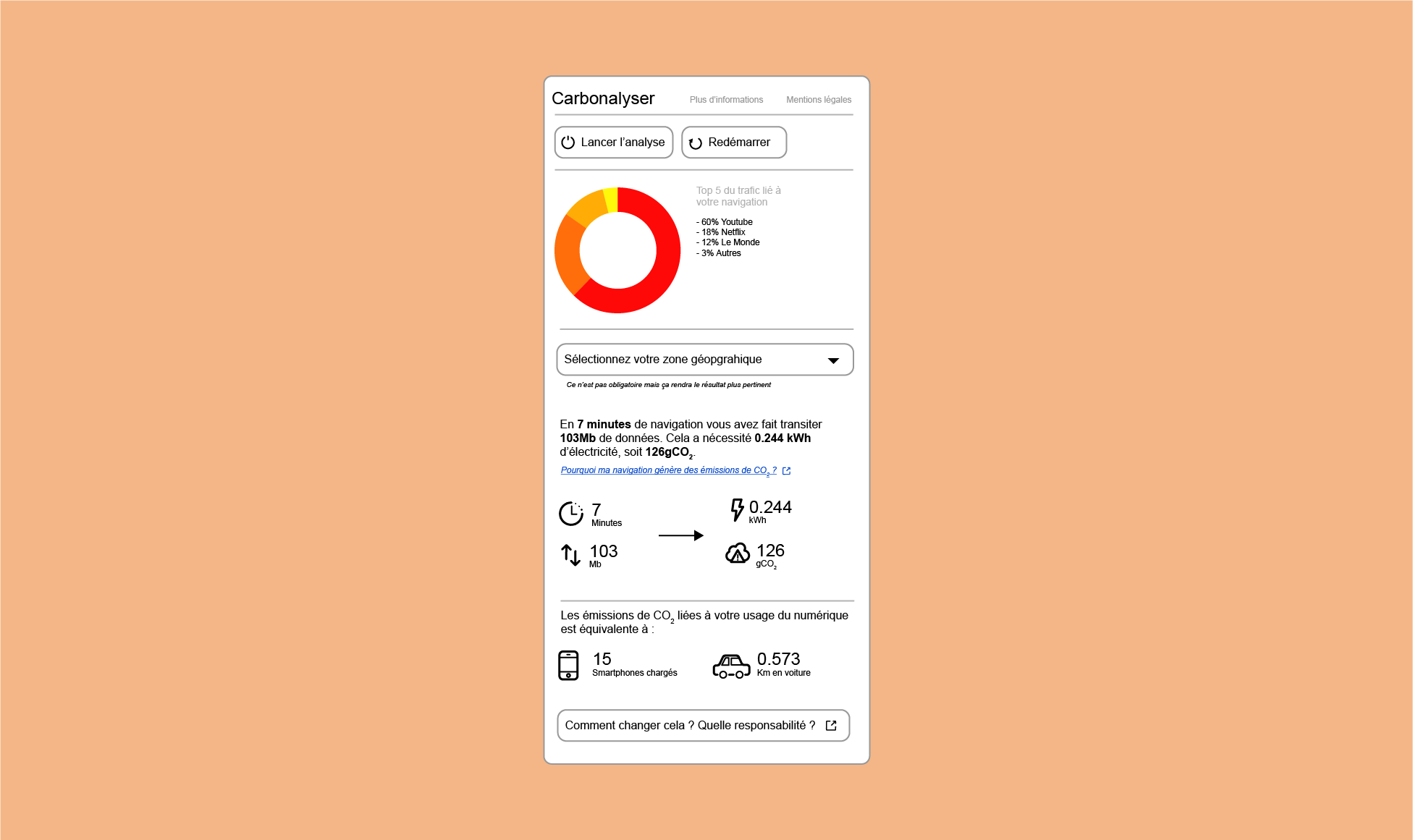

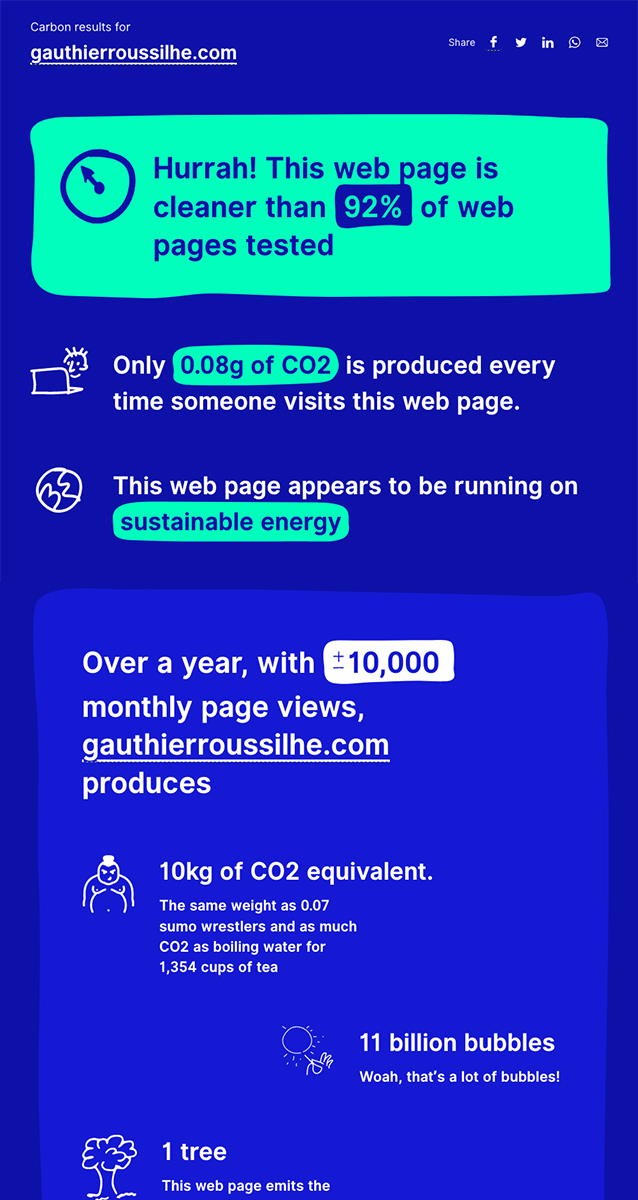

Décrire tous les impacts environnementaux liés à la production de l’infrastructure numérique (fabrication des serveurs, antennes, équipements, etc.) et à son usage est un exercice complexe et qui varie grandement en fonction des équipements, des méthodes de production et des territoires concernés. Cette description des impacts ne peut être précise que si elle se concentre sur une production d’équipement et son usage à une échelle explicitement définie. Par exemple, quels sont les impacts environnementaux liés à la production, à l’usage et à la fin de vie d’un iPhone 6, quels sont les impacts environnementaux liés au visionnage d’une heure de vidéo HD sur Youtube via la 4G sur ce même iPhone. Ce type de démarche s’appelle une analyse de cycle de vie (ACV). Les ACV sont utilisées pour définir tous les impacts liés à un produit dans un périmètre donné. Dans le cadre d’un service numérique, cela consiste à définir une “unité fonctionnelle”, c’est-à-dire, l’usage d’une fonction d’un produit ou d’un service comme : regarder une heure de vidéo HD sur Youtube en 4G sur un iPhone 6 en France. Dans ce cas précis l’iPhone est le vecteur matériel d’un usage : regarder une vidéo hébergée sur un serveur distant. Une fois que nous avons sélectionné l’unité fonctionnelle de notre analyse, nous devons fixer les limites de l’analyse : est-ce que nous intégrons la production, l’usage et la fin de vie, ou seulement deux étapes, voire une ? Finalement, nous pouvons choisir les critères à étudier : émissions de gaz à effet de serre, consommation d’eau douce, extraction de ressources non-renouvelables (minerais, métaux, etc.), consommation d’énergie primaire (pétrole, gaz, charbon, nucléaire, énergies renouvelables, etc.), pollution des sols (contamination liée à l’extraction, fabrication, fin de vie). Il est toujours compliqué de déterminer les frontières d’un système et donc les frontières de l’analyse, notamment dans le numérique. Les personnes dont le métier est de faire des analyses de cycle de vie s’accordent généralement sur un modèle commun afin de permettre la validité et la comparaison de leurs résultats. Dans le cas du numérique le modèle commun consiste à étudier les impacts environnementaux à trois endroits distincts : les centres de données, les réseaux et les équipements utilisateurs.

Définir les impacts

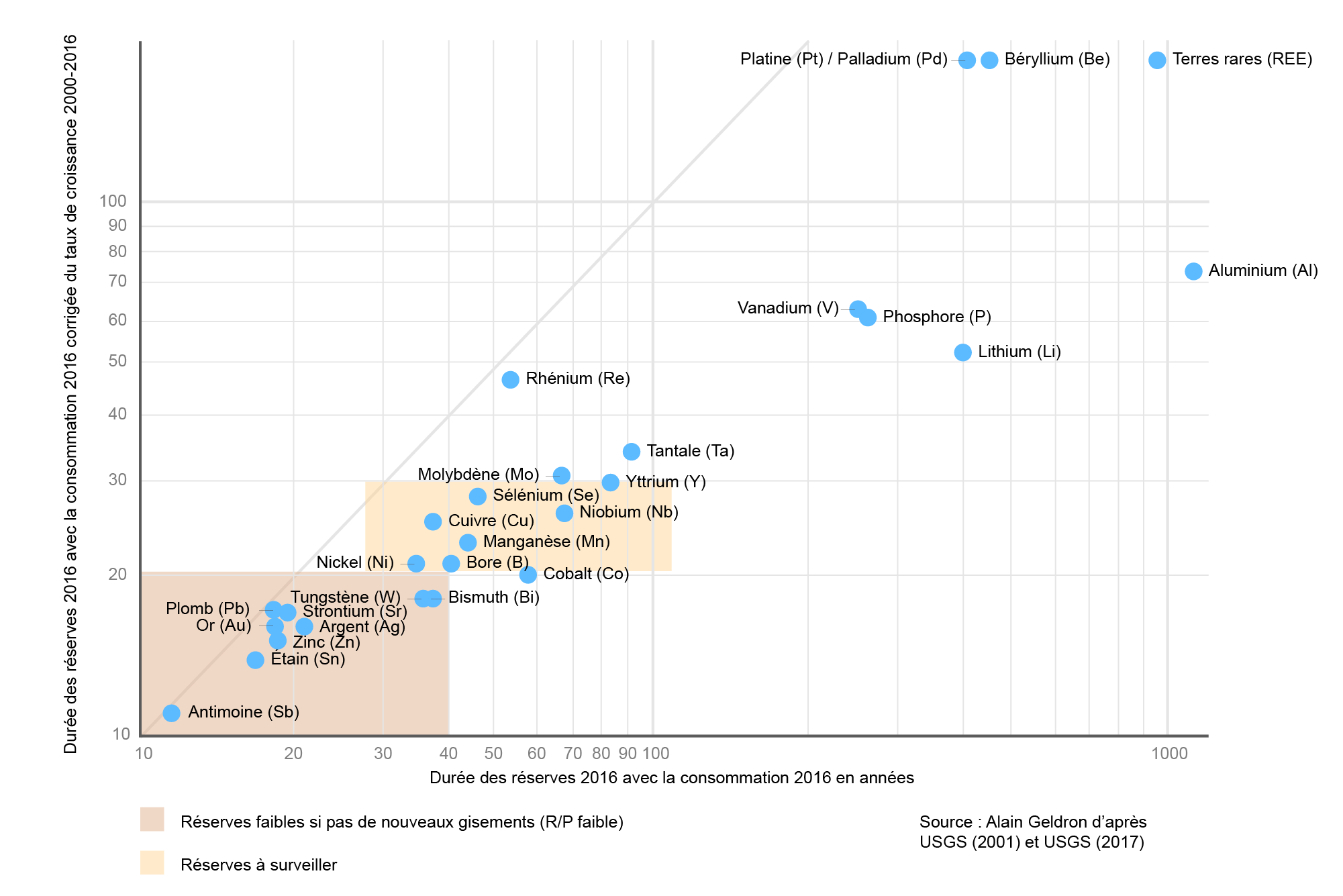

Toute personne cherchant à définir les impacts environnementaux d’une action, d’un usage numérique va donc regarder à trois endroits différents mais quels impacts cherche t-on exactement ? L’infrastructure numérique a des impacts multiples sur les écosystèmes : utilisation d’eau douce, extraction de minerais dans des écosystèmes fragiles, pollutions des sols, pollutions en décharge des équipements, émissions de gaz à effet de serre.. Un indicateur retient particulièrement l’attention aujourd’hui car il correspond aux objectifs de transition énoncés par les institutions nationales et internationales : les émissions de gaz à effet de serre. Ces gaz sont généralement émis à la production des équipements informatiques (fioul pour l’extraction et le transport, énergie pour faire tourner les lignes de production industrielle, les fonderies, etc.) et à la production de l’énergie nécessaire pour faire fonctionner ces équipements (production d’électricité). Les émissions de gaz à effet de serre sont donc directement reliés à la consommation énergétique de l’infrastructure numérique, c’est-à-dire à la fabrication et à l’utilisation des équipements. Toutefois, malgré l’attention portée aux émissions de gaz à effet de serre et donc à la consommation énergétique il ne faut pas mettre de côté les autres impacts prépondérants de l’infrastructure numérique : consommation de métaux et d’autres ressources associées, consommation d’eau, dégradation et pollution des écosystèmes. Pour avoir une image la plus claire possible de l’empreinte environnementale du numérique il est nécessaire d’utiliser tous ces critères et de les étudier avec une méthodologie globalement partagée.

La consommation énergétique

Dans un premier temps il s’agit de regarder la consommation énergétique liée à la fabrication et à l’usage des équipements au niveau des centres de données, des réseaux et des équipements utilisateurs. La fabrication d’équipements implique généralement des opérations de minage, de transformation, de transport, d’usinage et d’assemblage. La première question que l’on doit se poser est le type de matériel et d’équipements utilisés à chacune de ces étapes et le type d’énergie qui les fait fonctionner. Un tractopelle ou un camion sur un site minier ont tous deux besoin de carburant pour fonctionner, les génératrices utilisées par les premières opérations de nettoyage du minerai utilisent aussi du fioul, le bateau qui va transporter les minerais jusqu’à l’usine de raffinage va aussi consommer du fioul. L’usine qui va fondre le minerai pour en faire des lingots va être dépendante d’une centrale énergétique alimentée par du charbon, du gaz, du fioul ou d’autres énergies primaires. Une chaîne d’assemblage va aussi utiliser de l’électricité produite à partir de différentes sources d’énergie en fonction des pays. Mais cette consommation énergétique à la fabrication ne se résume pas seulement à l’extraction des minerais, il y a par exemple l’exploitation d’hévéa pour produire le caoutchouc qui enrobe une bonne partie des câbles et la production des composants plastiques par l’industrie pétrochimique, parmi bien d’autres étapes énergivores pour fabriquer cette infrastructure.

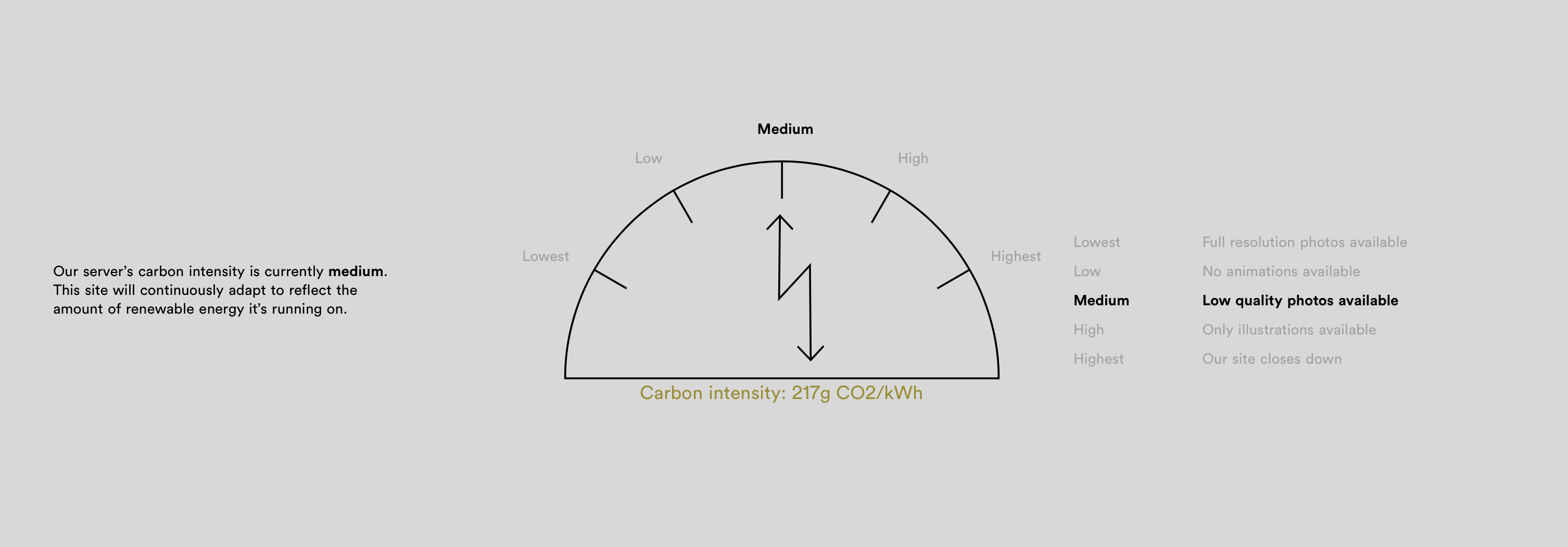

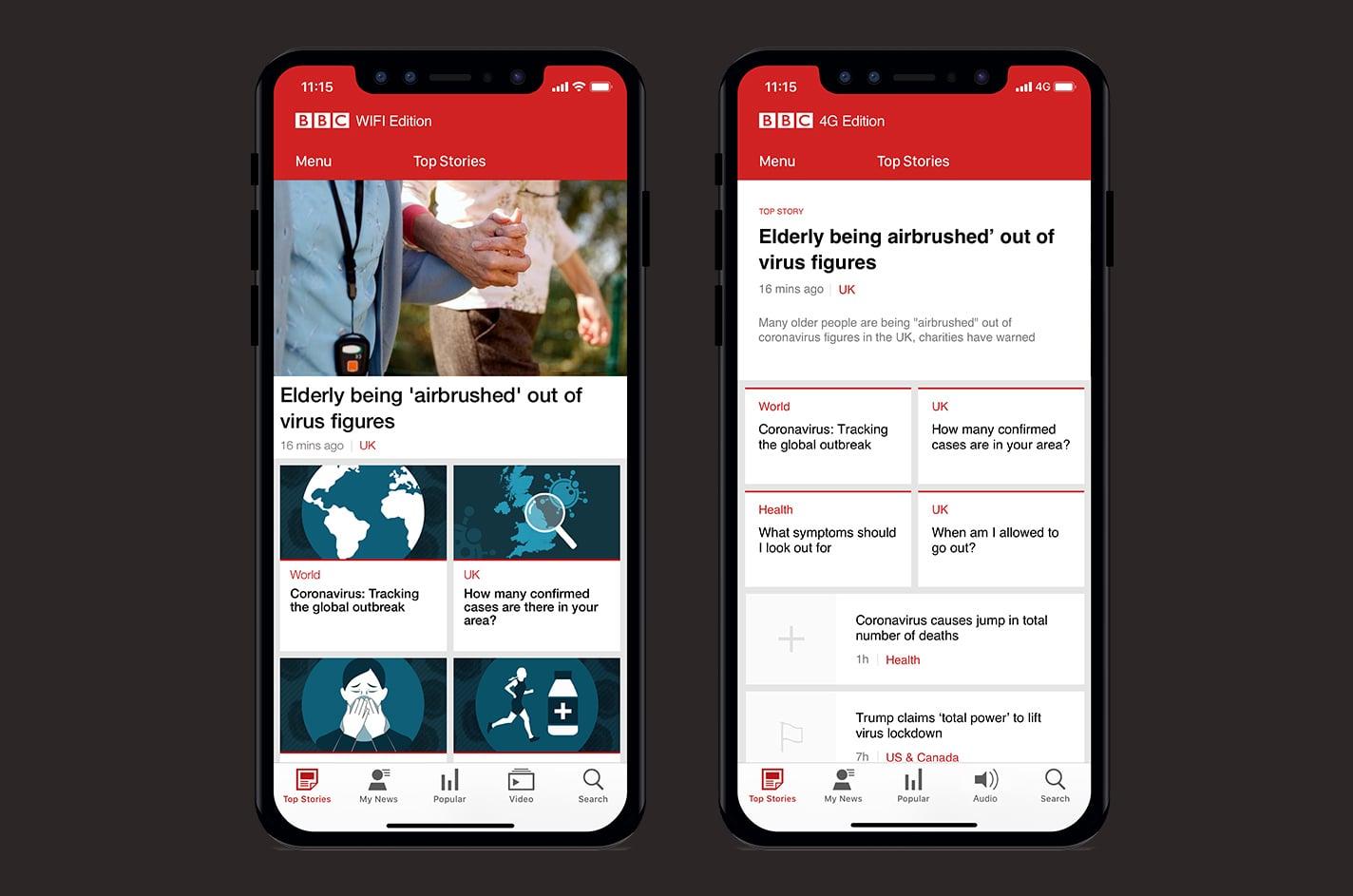

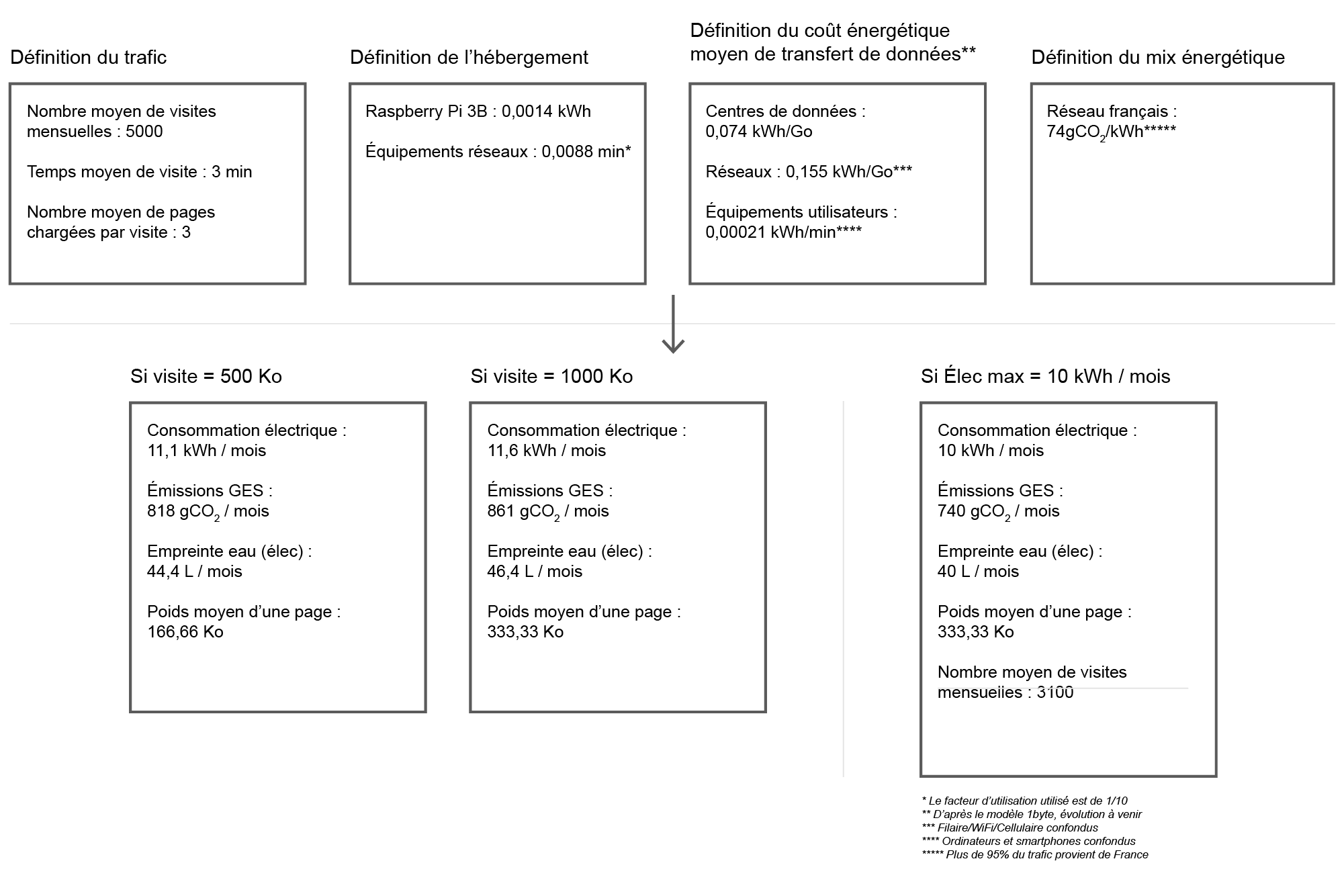

Une fois les équipements numériques fabriqués, livrés, vendus et installés, il est nécessaire de les alimenter en énergie pour les faire fonctionner. On utilise un vecteur d’énergie bien connu pour les mettre en route : l’électricité. Nous branchons la grande majorité de nos appareils numériques à une prise et nous les alimentant via un courant électrique. Une télévision connectée, un ordinateur, un frigo connecté, un smartphone, tous ces équipements sont reliés en permanence ou de façon temporaire à une prise. Une batterie permet de stocker de la puissance électrique afin de permettre à un appareil de pouvoir échapper temporairement à un raccordement à une prise électrique. On appelle cela l’autonomie. De plus, un des principaux objectifs d’amélioration de ces appareils est l’efficacité énergétique. Par exemple, on souhaite qu’un serveur informatique, pour 1 kWh (1000 watts consommés en 1h), puisse traiter plus de données. On peut aussi retourner la formulation : pour un 1 Gb de donnés transférées, on souhaite qu’un serveur consomme moins d’électricité. En 2020, les centres de données consomment toujours la même quantité d’électricité qu’en 2015, voire moins, alors que leur charge de travail a été multipliée par 2,7 et que le trafic a été multiplié par 4.